کوواریانس و نحوه محاسبه آن – به زبان ساده

یکی از شاخصهای مهم وابستگی بین دو متغیر تصادفی (Random Variable) در آمار، کوواریانس (Covariance) است. این مفهوم به شکلی با پراکندگی و معیار واریانس (Variance) ارتباط دارد. البته واریانس مربوط به یک متغیر است در حالیکه محاسبه کوواریانس ارتباط بین دو متغیر را بوسیله پراکندگیهایشان نسبت به میانگین، نشان میدهد. هر چه مقدار کوواریانس بین دو متغیر، بزرگتر باشد، میزان وابستگی بین آنها بیشتر است و برعکس اگر میزان کوواریانس بین دو متغیر کم باشد، وابستگی خطی بین آنها کم خواهد بود. در این نوشتار کوواریانس و نحوه محاسبه آن مورد بحث قرار گرفته است.

به منظور آشنایی بیشتر با مفاهیم مربوط به خصوصیات متغیرهای تصادفی و شاخصهای مربوطه، بهتر است به عنوان مقدمه، نوشتارهای امید ریاضی (Mathematical Expectation) — مفاهیم و کاربردها و متغیر تصادفی، تابع احتمال و تابع توزیع احتمال را مطالعه کنید. همچنین خواندن وابستگی، کوواریانس و ضریب همبستگی در علم داده — راهنمای کاربردی و ضریبهای همبستگی (Correlation Coefficients) و شیوه محاسبه آنها — به زبان ساده نیز خالی از لطف نیست.

کوواریانس و نحوه محاسبه آن

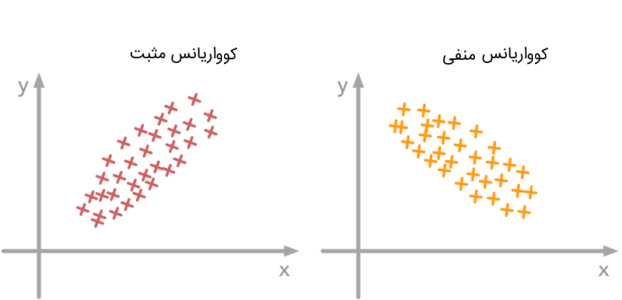

اغلب برای مشخص کردن میزان رابطه خطی بین دو متغیر تصادفی از کوواریانس استفاده میشود. مقدار کوواریانس دو متغیر، شامل مقادیر مثبت و منفی است. ولی هر چه مقدار کوواریانس به صفر نزدیکتر باشد، میزان وابستگی خطی بین آنها کمتر خواهد بود. مقادیر مثبت نشانگر رابطه هم جهت بین دو متغیر و مقادیر منفی کوواریانس نیز بیانگر رابطه معکوس بین آنها خواهد بود.

البته باید به این موضوع توجه داشت که کوواریانس و نحوه محاسبه آن (بدون در نظر گرفتن علامت)، شدت رابطه را مشخص نمیکند زیرا این شاخص به واحد اندازهگیری هر یک از متغیرها وابسته است. در نتیجه محاسبه کوواریانس با تغییر واحد اندازهگیری هر یک از متغیرها، متفاوت خواهد بود.

برای مثال متغیری که طول را نشان میدهد ممکن است با واحدهای مختلفی اندازهگیری شود. اگر واحد این متغیر از میلیمتر یا سانتیمتر به کیلومتر تغییر کند، کوواریانس کاهش خواهد یافت، زیرا اعداد مربوط به محاسبه طول کوچکتر میشوند و برعکس اگر طول را به جای اندازهگیری برحسب کیلومتر برحسب میلیمتر مشخص کنیم، کوواریانس متغیر طول نسبت به هر متغیر دیگری، افزایش زیادی خواهد داشت.

به همین دلیل برای مقایسه رابطه بین جفت متغیرها از کوواریانس استفاده نمیشود، مگر آنکه مقادیر متغیرها را به صورت استاندارد و بدون واحد در آورده، سپس محاسبه کوواریانس را انجام دهیم.

تعریف کوواریانس و نحوه محاسبه آن برای دو متغیر تصادفی

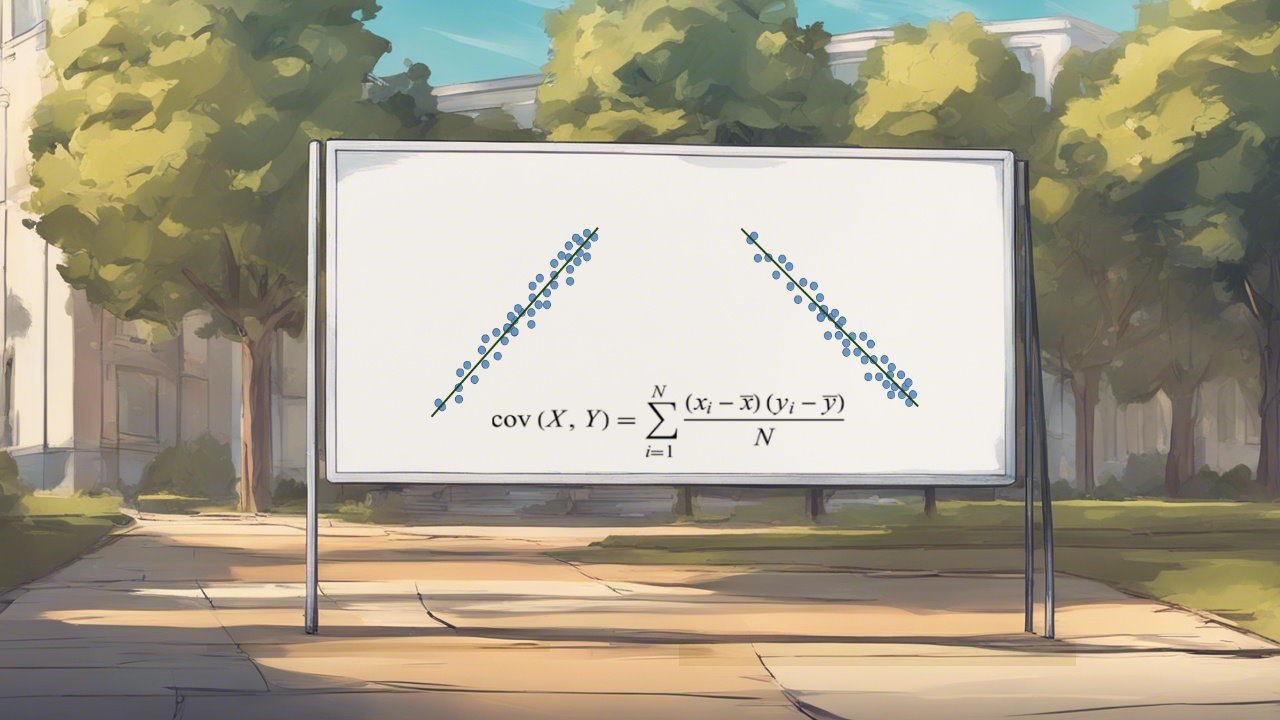

تابع توزیع توام دو متغیر تصادفی و را در نظر بگیرید. بر اساس این توزیع توام، قادر به محاسبه کوواریانس هستیم. البته فرض وجود گشتاور دوم متناهی برای این متغیرها نیز باید وجود داشته باشد. به این ترتیب کوواریانس، میانگین حاصلضرب فاصله هر یک از متغیرهای تصادفی از میانگینشان تعریف میشود. با توجه به این تعریف، شیوه محاسبه کوواریانس برای متغیرهای تصادفی حقیقی-مقدار مطابق با رابطه ۱ خواهد بود.

رابطه (۱) کوواریانس و نحوه محاسبه آن برای متغیرهای تصادفی و

که در آن و امید ریاضی یا مقدار چشمداشتی هر یک از متغیرهای و هستند.

همانطور که مشخص است کوواریانس، یک شاخص متقارن است به این معنی که . برای محاسبه کوواریانس شاید بهتر باشد که از رابطه سادهتری که در ادامه مشخص شده است، کمک گرفت. رابطه ۲ مشخص میکند که کوواریانس، تفاضل حاصل ضرب امید ریاضی هر یک از متغیرها از امید ریاضی حاصلضرب آنها است. به این ترتیب رابطه زیر اثباتی است که برمبنای رابطه ۱ نوشته شده و سادگی در انجام محاسبات را به همراه دارد.

رابطه (۲) کوواریانس و نحوه محاسبه آن برحسب امید ریاضی حاصلضرب متغیرهای تصادفی

نکته: شیوه محاسبه ارائه شده در رابطه ۲، ممکن است برای مقادیر بسیار نزدیک از متغیرهای تصادفی، دچار خطا گردد. این موضوع بخصوص برای برنامهها رایانهای ممکن است با خطای زیاد در کوواریانس و نحوه محاسبه آن همراه باشد.

واضح است که واحد یا مقیاس برای کوواریانس، برحسب حاصلضرب واحدهای دو متغیر تصادفی ساخته میشود. برای مثال اگر بخواهیم وابستگی بین دو متغیر تصادفی طول و وزن را مشخص کنیم، اگر طول با واحد متر و وزن با واحد کیلوگرم مشخص شده باشد، واحد شاخص کوواریانس برابر با متر در کیلوگرم خواهد بود. گاهی برای نمایش کوواریانس از نمادهای یا هم استفاده میشود.

مثال ۱

جفت متغیرهای تصادفی را با مقادیر در نظر بگیرید که و تابع توزیع توام نیز به شکل است. براساس تعریفی که در رابطه ۱ بیان شد، کوواریانس بین این دو متغیر به شکل زیر محاسبه خواهد شد.

به این ترتیب با کمی سادهسازی و محاسبه میانگین مقادیر به جای امید ریاضی به رابطه زیر خواهیم رسید.

به طور کلی اگر توزیع توام دو متغیر تصادفی گسسته به شکل باشد، کوواریانس بین آن دو به شکل زیر محاسبه خواهد شد.

مثلا توزیع توام دو متغیر تصادفی و را مطابق با تکیهگاه ذکر شده، به شکل زیر در نظر بگیرید.

جدول ۱: توزیع توام متغیرهای تصادفی و

همانطور که جدول ۱، نمایش میدهد، مقادیر برابر با مجموعه ۱ و ۲ بوده و متغیر نیز مقادیر ۱ و ۲ و ۳ را خواهد پذیرفت. میانگین (امید ریاضی) برای متغیر تصادفی نیز برابر با و برای متغیر تصادفی نیز خواهد بود. انحراف استاندارد این متغیرهای تصادفی نیز به ترتیب برابر با محاسبه میشود. در نتیجه کوواریانس این دو متغیر را به شکل زیر بدست خواهیم آورد.

کوواریانس و نحوه محاسبه آن برای متغیرهای تصادفی با مقادیر مختلط

فرض کنید متغیرهای تصادفی و با مقادیر مختلط باشند. در این صورت کوواریانس بین آن دو توسط رابطه ۳ محاسبه و بدست خواهد آمد.

رابطه (۳) کوواریانس و نحوه محاسبه آن برای متغیرها تصادفی با مقادیر مختلط

مشخص است که منظور از مزدوج مختلط متغیر تصادفی است.

خصوصیات کوواریانس و نحوه محاسبه آن

در ادامه به بعضی از خصوصیات جالب کوواریانس خواهیم پرداخت. البته توجه داشته باشید که کوواریانس به وابستگی خطی بین دو متغیر اشاره دارد.

- کوواریانس هر متغیر تصادفی با خودش، همان واریانس خواهد بود. به این ترتیب رابطه زیر برقرار است. مشخص است که این موضوع به کمک رابطه ۱ به خوبی قابل مشاهده است.

- کوواریانس ترکیب خطی از متغیرهای تصادفی نیز به شکل زیر محاسبه میشود. فرض بر این است که چهار متغیر تصادفی هستند که توزیع توام دو به دوی آنها نیز موجود است و نیز اعداد حقیقی هستند.

رابطه خطی را برای یک دنباله از متغیرهای تصادفی نیز میتوان تعمیم داد. در این حالت اگر یک دنباله از متغیرهای تصادفی با یک تابع توزیع توام مشخص باشد و نیز اعداد حقیقی در نظر گرفته شوند، آنگاه رابطه زیر بین کوواریانس زوج متغیرها و واریانس ترکیب خطی از آنها برقرار خواهد بود.

$$ \large { \displaystyle \sigma ^{2} \left( \sum _{ i = 1 }^{ n } a_{i} X_{i} \right) = \sum _{i=1}^{n} a_{i}^{2} \sigma ^{2}(X_{i}) + 2 \sum _{i,j\,:\,i<j} a_{i} a_{j} \operatorname {cov} (X_{i} , X_{j}) = \sum _{i,j} {a_{i} a_{j} \operatorname {cov} (X_{i} , X_{j})}} $$

- نامساوی هوفدینگ برای کوواریانس (Hoeffding's Covariance Identity) نیز به شکل زیر نوشته میشود.

که در آن تابع توزیع تجمعی (CDF) متغیر تصادفی است و نیز توزیع توام تجمعی متغیرهای تصادفی و است.

- کوواریانس متغیرهای تصادفی ناهمبسته صفر است. در حقیقت دو متغیر تصادفی را ناهمبسته (Uncorrelated) مینامند اگر مقدار کوواریانس بین آنها صفر باشد. از طرفی برای دو متغیر تصادفی مستقل نیز مقدار کوواریانس صفر خواهد بود. این موضوع در رابطه زیر مشخص شده است.

- کوواریانس صفر دلیلی بر مستقل بودن دو متغیر نیست. در واقع عکس عبارت بالا همیشه صحیح نخواهد بود. به این معنی که اگر مقدار کوواریانس برابر با صفر باشد، دلیلی بر مستقل بودن دو متغیر نمیتوان ارائه کرد. برای مثال فرض کنید و باشد. آنگاه میتوان به وسیله روابط زیر نشان داد که کوواریانس بین این دو متغیر تصادفی صفر است در حالیکه مشخص است مستقل از نیست. البته این نکته را هم باید در نظر گرفت که صفر بودن کوواریانس بین دو متغیر با شرط توزیع توام نرمال، نشانگر استقلال آن دو خواهد بود.

کوواریانس و نحوه محاسبه آن براساس ضرب داخلی دو بردار تصادفی

بسیاری از خواص کوواریانس و نحوه محاسبه آن را به واسطه ضرب داخلی دو بردار (Inner Product) میتوان مشخص کرد. برای مثال میتوان به رابطه تقارن در کوواریانس اشاره کرد که کاملا شبیه ضرب داخلی است. همچنین حفظ رابطه خطی بین متغیر یا بردارهای تصادفی نیز از ویژگیهای دیگری است که در ضرب داخلی نیز وجود دارد. از طرفی دیدیم که کوواریانس هر متغیر تصادفی با خودش، واریانس را مشخص میکند. این امر نشانگر نامنفی بودن کوواریانس متغیر تصادفی با خودش است زیرا حاصل واریانس متغیر تصادفی را نشان میدهد. این امر نیز در ضرب برداری دیده میشود. ضرب داخلی هر بردار در خودش، نیمه معین مثبت (Positive Semi-Definite) است.

به این ترتیب میتوان کوواریانس و نحوه محاسبه آن را مشابه ضرب داخلی دو بردار تصادفی در نظر گرفت. به کمک این خصوصیت میتوان با استفاده از نامساوی کوشی-شوارتز (Cauchy-Schwartz Inequality) برای بردارها و ضرب داخلی آنها، خاصیت جالبی را برای کوواریانس مشخص کرد و یک کران بالا برای کوواریانس دو متغیر تصادفی ایجاد کرد. این موضوع در رابطه زیر دیده میشود.

رابطه بالا به شرط متناهی بودن واریانس دو متغیر تصادفی برقرار است. اثبات این نامساوی به شکل زیر صورت میگیرد.

اگر ، به طور وضوح، نامساوی برقرار است (این موضوع را در اولین خاصیت ترکیب خطی کوواریانس معرفی کردیم که کوواریانس متغیر تصادفی با مقدار ثابت برابر با صفر است). حال وضعیتی را در نظر بگیرید که در آن متغیر تصادفی به شکل زیر تعریف شده است.

در نتیجه خواهیم داشت:

همانطور که مشخص است به راحتی کران بالا برای کوواریانس دو متغیر برحسب حاصل ضرب واریانس هر یک ساخته شد.

کوواریانس و نحوه محاسبه آن برای یک نمونه تصادفی

کوواریانس نمونهای برای متغیر تصادفی و با نمونه تصادفی برگرفته از جامعه آماری تشکیل یک ماتریس میدهد که هر یک از مولفههای آن به شکل زیر حاصل میشوند.

این مولفهها، برآوردی برای کوواریانس مولفهای جامعه آماری محسوب میشوند. حتما توجه دارید که در مخرج کسر از استفاده شده تا برآوردگرهای حاصل، نااریب (Unbiased) باشند زیرا میدانیم برای محاسبه کوواریانس باید عمل برآورد را هم برای میانگین جامعه آماری انجام داده، در نتیجه یک واحد از درجه آزادی (Degree of Freedom) کسر خواهد شد. البته توجه داشته باشید که اگر میانگین جامعه آماری مشخص باشد، نحوه محاسبه کوواریانس نمونهای به شکل زیر درخواهد آمد. مشخص است که این بار مخرج کسر برابر با است و از درجه آزادی، مقداری کاسته نخواهد شد.

به این ترتیب هر گاه براساس نمونه بخواهیم کوواریانس و نحوه محاسبه آن را به درستی مشخص کنیم از رابطه اخیر کمک خواهیم گرفت.

ماتریس واریانس-کوواریانس بردارهای تصادفی

در قسمت قبل، مبنای محاسبات، متغیرهای تصادفی بودند که واریانس ثابت و متناهی داشتند. در این حالت نحوه محاسبه کوواریانس و کاربردهای آن را مرور کردیم. ولی در این جا بردارهای تصادفی ملاک هستند و براساس آنها میخواهیم ماتریس کوواریانس را بدست آوریم. ابتدا ماتریس کوواریانس یک بردار تصادفی سپس ماتریس کوواریانس بین دو بردار تصادفی را مرور خواهیم کرد.

ماتریس کوواریانس و نحوه محاسبه آن برای بردار تصادفی

در حالت چند متغیره نیز کوواریانس و نحوه محاسبه آن برایمان مهم است زیرا اغلب با پدیدههای مواجه هستیم که بین ویژگی یا متغیرهای آن رابطهای وجود دارد. یک بردار تصادفی -بُعدی مثل که تشکیل شده از متغیر تصادفی با توزیع توام و گشتاور دوم متناهی را در نظر بگیرید. «ماتریس کوواریانس» (Covariance Matrix) که گاهی به آن «ماتریس واریانس-کوواریانس» (Variance-Covariance Matrix) نیز گفته میشود با نماد یا نشان داده شده و به صورت زیر محاسبه میشود.

توجه داشته باشید که علامت همان ترانهاده ماتریس در نظر گرفته شده است.

با توجه به تعریفی که از ماتریس واریانس-کوواریانس ارائه شد، میتوانیم ترکیب خطی از این بردار را در نظر گرفته و کوواریانس حاصل از ترکیب خطی را هم به مانند حالت تک متغیره محاسبه کنیم. فرض کنید که یک ماتریس باشد که قابلیت ضرب در بردار تصادفی را از چپ داشته باشد. واضح است که شامل ضرایب ترکیب خطی است. در این صورت محاسبه ماتریس کوواریانس به شکل زیر خواهد بود.

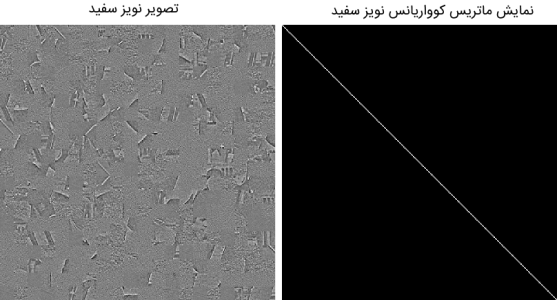

رابطه بالا براساس خاصیت خطی بودن امید ریاضی است و میتواند بخصوص برای تبدیلات خطی بردارها مانند تبدیل کروی (Sphering Transformation) اشاره کرد که توسط آن یک بردار با ماتریس کوواریانس مشخص، تبدیل به برداریهای ناهمبسته با واریانس واحد میشود. معمولا این تبدیل را با نام «تبدیل سفیدگر» (Whiting Transformation) نیز میشناسند زیرا بردار ورودی را تبدیل به برداری از نویزهای سفید خواهد کرد که دارای واریانس واحد بوده و از هم مستقل هستند.

ماتریس کوواریانس و نحوه محاسبه آن برای بردارهای تصادفی با مقادیر حقیقی

این بار بردارهای و را در نظر بگیرید که متعلق به یک فضای برداری هستند بطوری که و آنها را مشخص کرده است. در این صورت «ماتریس کوواریانس متقاطع» (Cross-Covariance Matrix)، دارای سطر و ستون بوده و به شکل زیر محاسبه میگردد.

در رابطه بالا ترانهاده بردار یا ماتریس است. هر یک از عناصر این ماتریس، کوواریانس بین متغیری از بردار و را نشان میدهد. برای مثال عنصر سطر ام و ستون ام برابر با است که همان کوواریانس بین متغیر تصادفی از بردار و متغیر تصادفی ام از بردار تصادفی است.

نکته: توجه داشته باشید که به علت خاصیت جابجایی در ضرب برای امید ریاضی، ماتریس کوواریانس بردارهای تصادفی، متقارن است. به این معنی که ترانهاده ماتریس کوواریانس با خود ماتریس کوواریانس برابر است.

تاریخچه کوواریانس و نحوه محاسبه آن

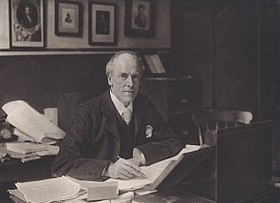

«کارل پیرسون» (Carl Pearson) دانشمند و ریاضیدان انگلیسی، که «ضریب همبستگی خطی پیرسون» (Pearson Correlation) را به نام خود ثبت کرده است به بررسی رابطه خطی بین دو متغیر پرداخت. او وضعیتی را در نظر گرفت که دو متغیر به صورت خطی با یکدیگر در ارتباط بودند. متغیر اول را و متغیر دوم را در نظر بگیرید. نقاط حاصل از این دو متغیر در صفحه مختصات دکارتی را به صورت زوجهای مرتب مشخص میکنیم. پیرسون که مبدع روش رگرسیون (Regression) هم محسوب می شود، توانست ضریبی را برای نشان دادن میزان وابستگی خطی بین دو متغیر معرفی کند. او مشخص کرد که خط رگرسیونی از میانگین و یعنی نقطه میگذرد.

بنابراین اگر بخواهیم معادله خط رگرسیونی را بنویسیم میتوانیم با کمک دو نقطه از این خط، ضرایب را مشخص کنیم. یکی از نقطهها را و دیگری را همان در نظر میگیریم. پس خواهیم داشت:

با طرفین وسطین کردن این رابطه به معادله زیر خواهیم رسید.

همانطور که مشاهده میکنید، این جمله بسیار به کوواریانس و نحوه محاسبه آن برحسب رابطه ۱، شبیه است. اگر نقاط و را که بوده و حتما در این رابطه صدق میکنند به جای و قرار دهیم پس از میانگینگیری، به فرمول کوواریانس خواهیم رسید.

به همین علت گفته میشود که کوواریانس میزان وابستگی خطی بین دو متغیر را مشخص میکند. البته میدانیم که ضریب همبستگی نیز حالتی از نرمال شده کوواریانس و نحوه محاسبه آن نیز هست. هر چه وابستگی خطی بین دو متغیر بیشتر باشد، ضریب همبستگی پیرسون به ۱ یا ۱- نزدیکتر خواهد بود و در صورت وجود رابطه خطی کامل بین آنها، ضریب همبستگی برابر با ۱ یا ۱- میشود.

کاربردهای کوواریانس

کوواریانس و نحوه محاسبه آن کاربردهای زیادی برای نمایش یا بررسی میزان وابستگی خطی بین متغیرها یا بردارهای تصادفی دارد. در ادامه این متن به بعضی از آنها اشاره خواهیم کرد.

- در ژنتیک و بیولوژی مولکولی از کوواریانس برای نمایش وابستگی بین توالیهای ژنها و پرونئینها استفاده میشود. به این ترتیب برای کوواریانس و نحوه محاسبه آن نقش مهمی در تهیه «ماتریس رابطه ژنتیک» (Genetic Relation matrix) دارد. این ماتریس در توصیف توالی DNAها به کار میرود.

- در حوزه علوم مالی و اقتصاد نیز کوواریانس و نحوه محاسبه آن برای نمایش وابستگی خطی بین متغیرها به کار میرود. در ایجاد مدلهای قیمتگذاری دارایی سرمایهای کوواریانس نقش مهمی ایفا میکند. به این ترتیب میزان وابستگی بین داراییها که توسط کوواریانس محاسبه میشوند سبد سرمایهگذاری مناسبی را تشکیل دهند.

- ماتریس کوواریانس و نحوه محاسبه آن برای استخراج ویژگی (Feature Extraction) نیز به کار میرود. به این ترتیب متغیرهایی که وابستگی کمتری با یکدیگر داشته و بیشترین توصیف را از مشاهدات در خود داشته باشند، پیدا و برای تحلیلهای آماری به کار میبرند.

- ماتریس کوواریانس در برآورد شرایط اولیه مورد نیاز برای اجرای مدلهای پیش بینی وضعیت هوا، مورد استفاده قرار میگیرد. در روشی که معروف به جذب دادهها (Data Assimilation) است، «ماتریس کواریانس خطای پیش بینی» (Forecast Error Covariance Matrix) به طور معمول ارتباط بین آشفتگیهای دما و دیگر ویژگیهای آب و هوایی با یک نقطه معیار (که معمولا میانگین در نظر گرفته میشود) را نشان میدهد. واضح است که ماتریس همان کوواریانس بین متغیرها است. مقادیر روی قطر اصلی این ماتریس همان پراکندگی یا واریانس بوده و عناصر خارج از قطر هم وابستگی خطی یا کوواریانس بین متغیرها را نشان میدهد. این ماتریس کاربردهای گستردهای در به کارگیری فیلتر کالمن (Kalman Filter) بخصوص در سیستمهای وابسته به زمان دارد.

خلاصه و جمعبندی

در این نوشتار با کوواریانس و نحوه محاسبه آن آشنا شدیم. به کمک مثالهایی که ارائه شد، محاسبات مربوط به کوواریانس نیز مرور شدند. خصوصیات و نحوه بدست آوردن ماتریس کوواریانس نیز از مواردی بود که در این متن به آنها پرداختیم. همانطور که اشاره شد، کوواریانس میزان رابطه خطی بین دو متغیر یا بردارهای تصادفی را نمایش و محاسبه میکند. مقدار نرمال شده کوواریانس نیز به نام ضریب همبستگی (Correlation Coefficient) در بازه ۱ یا ۱- تغییر کرده که برای مقایسه شدت رابطه خطی بین زوج متغیرهای مختلف، مناسبتر است.

آزمون کوواریانس و نحوه محاسبه آن

۱. کوواریانس بر چه اساسی میزان وابستگی خطی دوسویه میان دو متغیر تصادفی را بیان میکند؟

با اندازهگیری مجموع مقادیر هر متغیر بدون توجه به دیگری

با بررسی تعداد همارز بودن مقادیر دو متغیر در دادهها

با سنجش جهت و میزان تغییرات همزمان دو متغیر نسبت به میانگینهایشان

با محاسبه پراکندگی هر متغیر نسبت به مقدار میانگین خودش

کوواریانس مقدار ارتباط خطی را با سنجش «جهت و میزان تغییرات همزمان دو متغیر نسبت به میانگینهایشان» بیان میکند؛ به این معنی که اگر تغییرات دارای جهت همسو یا مخالف باشند، کوواریانس مثبت یا منفی خواهد شد.

۲. کدام تفاوت اصلی در نحوه عملکرد کوواریانس و واریانس برای سنجش پراکندگی و ارتباط متغیرها وجود دارد؟

واریانس و کوواریانس هر دو فقط وابستگی غیرخطی متغیرها را میسنجند.

کوواریانس میزان پراکندگی و نوع ارتباط بین دو متغیر را نسبت به میانگین آنها بررسی میکند.

کوواریانس فقط پراکندگی یک متغیر را نسبت به میانگینش میسنجد.

واریانس همیشه نشاندهنده رابطه خطی بین دو متغیر است.

کوواریانس میزان پراکندگی و نوع ارتباط بین دو متغیر را نسبت به میانگین آنها بررسی میکند. کوواریانس رابطه خطی را میان دو متغیر توصیف میکند و میتواند مثبت، منفی یا نزدیک به صفر باشد و همجهتی یا رابطه معکوس را نشان دهد. اما واریانس فقط برای یک متغیر کاربرد دارد.

۳. فرمول محاسبه کوواریانس بین دو متغیر تصادفی چگونه تعریف میشود و اجزای آن به چه چیزی اشاره دارند؟

کوواریانس برابر مجموع دادههای هر متغیر تقسیم بر تعداد دادهها است.

کوواریانس برابر تفاضل میانگین هر متغیر است.

کوواریانس میانگین حاصلضرب تفاضل هر متغیر از میانگین خودش است.

کوواریانس حاصلضرب واریانس دو متغیر تصادفی است.

طبق تعریف ریاضی کوواریانس، برای دو متغیر X و Y، کواریانس بر پایه میانگین ضرب (X منهای میانگین X) و (Y منهای میانگین Y) محاسبه میشود.

۴. اگر واحد اندازهگیری یکی از متغیرها تغییر کند، چه اثری بر مقدار کوواریانس خواهد داشت؟

کوواریانس به همان نسبت تغییر واحد تغییر میکند.

کوواریانس مقدارش ثابت میماند و تغییر نمیکند.

کوواریانس فقط با تغییر هر دو واحد متغیر تغییر میکند.

کوواریانس به سمت صفر میل میکند اما از بین نمیرود.

تغییر واحد اندازهگیری یکی از متغیرها باعث میشود کوواریانس مستقیما به همان نسبت تغییر واحد ضرب شود. مثلا اگر واحد یک متغیر دو برابر شود، مقدار کوواریانس نیز دو برابر خواهد شد. بنابراین مقایسه مستقیم کوواریانس برای متغیرهایی با واحدهای مختلف صحیح نیست، چون مقدار آن وابسته به واحد اندازهگیری است. این ویژگی باعث میشود تنها زمانی بتوان کوواریانسها را به درستی مقایسه کرد که واحد متغیرها یکسان یا استاندارد شود.

۵. اگر کوواریانس دو متغیر برابر با صفر باشد، آیا همیشه نشانه استقلال آنهاست؟

بله، چون کوواریانس صفر نشانه استقلال کامل است.

بله، چون با کوواریانس صفر رابطه متقارن نیست.

خیر، چون فقط برای توزیع نرمال این شرط برقرار است.

خیر، زیرا ممکن است وابستگی غیرخطی وجود داشته باشد.

وقتی کوواریانس دو متغیر صفر است، الزاما به این معنا نیست که آنها مستقل هستند؛ بلکه فقط نشاندهنده نبود وابستگی خطی است. ممکن است میان دو متغیر وابستگی غیرخطی وجود داشته باشد؛ مانند مثال Y = X² که در آن کوواریانس صفر است ولی متغیرها وابستهاند. تنها برای توزیعهای خاصی مانند توزیع نرمال کوواریانس صفر به استقلال آماری منجر میشود.

۶. در فضای چندبعدی، وجود خاصیت تقارن و خطی بودن در کوواریانس چه کاربردی در ساخت ماتریس واریانس-کوواریانس برای بردارهای تصادفی دارد؟

ماتریس واریانس-کوواریانس فقط در حالت بردارهای مستقل تعریف میشود.

باعث تشکیل ماتریسی با درایههای متقارن نسبت به قطر اصلی میشود.

اجزای ماتریس همواره برابر با مقدار میانگین بردارهاست.

ماتریس ساخته شده فقط مقدارهای مثبت خواهد داشت.

وجود خاصیت تقارن در کوواریانس باعث میشود درایههای ماتریس واریانس-کوواریانس نسبت به قطر اصلی متقارن باشند، یعنی کوواریانس بین متغیر i و j با کوواریانس بین متغیر j و i برابر است. خاصیت خطی بودن نیز باعث حفظ ارتباط خطی میان اجزای ماتریس میگردد. این ویژگیها تضمین میکند که ماتریس حاصل ساختاری متقارن داشته باشد.

۷. چرا هنگام محاسبه کوواریانس نمونهای بهجای N از N-1 در مخرج فرمول استفاده میشود؟

استفاده از N-1 باعث میشود کوواریانس به ماتریس تقارنپذیر تبدیل شود.

استفاده از N-1 باعث حذف واحد اندازهگیری از کوواریانس میشود و مقایسه متغیرها را ساده میکند.

استفاده از N-1 باعث میشود برآورد کوواریانس با خطای کمتری انجام گیرد و میانگین دادههای نمونه جایگزین میانگین واقعی شود.

استفاده از N-1 باعث افزایش وابستگی کوواریانس به مقیاس دادهها میشود.

در فرمول کوواریانس نمونهای، زمانی که میانگین ناشناخته و از دادههای نمونه محاسبه میشود، بهجای N از N-1 استفاده میشود تا اثر از دست رفتن یک درجه آزادی جبران گردد. این کار، کوواریانس محاسبهشده را به یک برآوردگر نااریب تبدیل میکند. در صورتی که از N-1 استفاده نشود و فقط N در مخرج باشد، برآورد کوواریانس کمتر از مقدار واقعی خواهد بود و اعتبار آماری کاهش مییابد.

۸. در دادهکاوی، اگر هدف حذف وابستگی خطی بین چند متغیر براساس ساختار ماتریس کوواریانس باشد، کدام روش موثر است و این کار چه تاثیری در آمادهسازی دادهها دارد؟

استفاده از Whitening Transformation برای بیهمبستگی متغیرها و سادهسازی تحلیل آماری

انتخاب تصادفی زیرمجموعههایی از دادهها برای کاهش واریانس نمونهای

تبدیل تمامی مقادیر به مقیاس صفر تا یک برای حذف تفاوت واحدها

کاهش تعداد ویژگیها با استفاده از الگوریتم k-means و حذف ویژگیهای کماهمیت

در این شرایط، "Whitening Transformation" موجب میشود وابستگی خطی بین متغیرها حذف شده و عناصر خارج از قطر ماتریس کوواریانس به صفر نزدیک شوند. این کار باعث میشود دادهها بدون همبستگی باشند و تحلیل آماری یا مدلسازی دقیقتر و سادهتر شود.

۹. اگر ماتریس کوواریانس بین دو بردار تصادفی ویژگی تقارن نداشته باشد، چه اثری بر تحلیل مدل آماری چندبعدی دارد؟

ویژگی مثبت معین بودن به طور کامل حفظ میشود.

این ماتریس نمیتواند رابطه درست بین اجزای دو بردار را نمایش دهد.

تمام مولفهها در مدل آماری مستقل در نظر گرفته میشوند.

سطرها و ستونهای ماتریس کاملا قابل جابجایی خواهند بود.

در صورتی که ماتریس کوواریانس تقارن خود را از دست بدهد، بیانگر آن است که رابطه کوواریانس بین مولفههای دو بردار به درستی نمایش داده نمیشود، زیرا بر اساس تعریف، کوواریانس باید خاصیت متقارن داشته باشد. این تقارن تضمین میکند که میزان وابستگی بین هر دو مولفه از دو بردار مستقل از ترتیب انتخاب آنهاست. اگر این خاصیت نقض شود، نتایج مدل آماری چندبعدی قابل اعتماد نبوده و تحلیل دادهها مخدوش میگردد.

محاسبه کواریانس e به توان y_ ؟

(تابع نمایی منفی y)

باسلام و عرض خسته نباشید

رابطه کوواریانس با برازش توزیع نرمال چند متغیره چیست؟ همچنین رابطه کی دو با برازش توزیع نرمال چند متغیره چیست؟

چرا توزیع کی دو همیشه چوله به راست است؟

ممنون میشم پاسخ دهید

سلام

ممنون

یه سوال: آیا کوواریانس در برابر داده های غیر نرمال هم مقاوم (Robust) است؟

ممنون. عالی بود.