کامپیوتر کوانتومی چیست؟ – به زبان ساده

کامپیوتر کوانتومی وسیلهای است که با بکارگیری یک سری مفاهیم کوانتومی مانند اصل برهمنهی و درهمتنیدگی، سرعت و قدرت پردازش بالاتری برای انجام محاسبات و عملیات منطقی در مقایسه با کامپیوترهای معمولی ارائه میدهد. این کامپیوترها با استفاده از کیوبیت بهجای بیت، میتوانند برخی از محاسبات و چالشهای خارج از توان ابرکامپیوترها را حل کنند. مطالعات در این زمینه با رویکرد استفاده از این کامپیوترها در کنار انواع دیگر (و نه جایگزینی به جای آنها) در حال انجام است. در این مطلب از مجله فرادرس قصد داریم تا با زبانی ساده توضیح دهیم که یک کامپیوتر کوانتومی چیست و چگونه کار میکند.

- یاد میگیرید کیوبیت چیست و چه تفاوتی با بیت دارد.

- با چالشهای مهندسی و فنی مانند ناهمدوسی و سردسازی آشنا میشوید.

- روشهای متداول پیادهسازی کیوبیت و مزیتها و معایب هر کدام را خواهید شناخت.

- یاد میگیرید الگوریتمهای کلیدی کوانتومی مثل شور و گراور چگونه عمل میکنند.

- میآموزید اجزای سختافزاری و نرمافزاری کامپیوتر کوانتومی چه نقشی دارند.

- کاربردهای اصلی کامپیوتر کوانتومی را در حوزههایی مانند رمزنگاری تحلیل میکنید.

به همین منظور در اولین بخش سعی کردهایم به این سوالات بهصورت کلی پاسخ دهیم و مروری بر علت پیدایش و روند توسعه کامپیوتر کوانتومی داشته باشیم. سپس مطلب را با بیان سه تفاوت اصلی کامپیوتر کوانتومی و کلاسیکی شروع میکنیم که شامل استفاده از کیوبیت بهجای بیت، مقایسه تعداد گیتهای منطقی پایه و جهت انجام عملیات منطقی است. همچنین در ادامه، اصول کوانتومی حاکم بر عملکرد یک کامپیوتر کوانتومی شامل درهمتنیدگی، برهمنهی، ناهمدوسی و تداخل را توضیح میدهیم و پس از اینکه کیوبیت و تفاوت آن با بیت را کاملا توضیح دادیم، به معرفی انواع کیوبیتها و بیان ویژگیهای هر کدام خواهیم پرداخت. بخشهای پایانی این نوشته به معرفی سخت افزار و نرمافزار کوانتومی، معروفترین کامپیوترهای کوانتومی جهان و کاربرد کامپیوترهای کوانتومی اختصاص دارد.

کامپیوتر کوانتومی چیست و چگونه کار میکند؟

ویژگی مهم کامپیوتر کوانتومی در استفاده از کیوبیتها بهجای بیتهای معمولی با دو حالت یا است. هر سیستم کوانتومی دو حالتهای مانند اسپین الکترون، یونهای به دام افتاده یا نور قطبیده میتواند بهعنوان کیوبیت برای ساخت کامپیوتر کوانتومی استفاده شود. کیوبیتها علاوه بر حالت و ، میتوانند در حالت جدیدی به نام «حالت برهمنهی» (ترکیبی از و ) نیز قرار بگیرند. این ویژگی همراه با درهمتنیدگی کوانتومی موجب شده است تا بتوانیم در یک کامپیوتر کوانتومی اطلاعات و دادههای بیشتری را بهصورت تصاعدی پردازش کنیم.

در یک کامپیوتر کوانتومی تا زمانی که یک جفت کیوبیت درهمتنیده باشند، هر دو همزمان در حالتی به نام حالت برهمنهی قرار دارند. به محض اینکه یکی از این دو کیوبیت اندازهگیری شود، برهمنهی کوانتومی از بین میرود. در نتیجه موقعیت کیوبیت اندازهگیری نشده کاملا مخالف موقعیت کیوبیت اندازهگیری شده فرض میشود. برای مثال اگر اولی در حالت مشاهده شود، دومی قطعا در حالت است. بنابراین یک کامپیوتر کوانتومی قادر است اطلاعات را بهصورت آنی و با سرعتی بیشتر از سرعت نور منتقل کند.

مروری بر روند توسعه کامپیوترهای کوانتومی

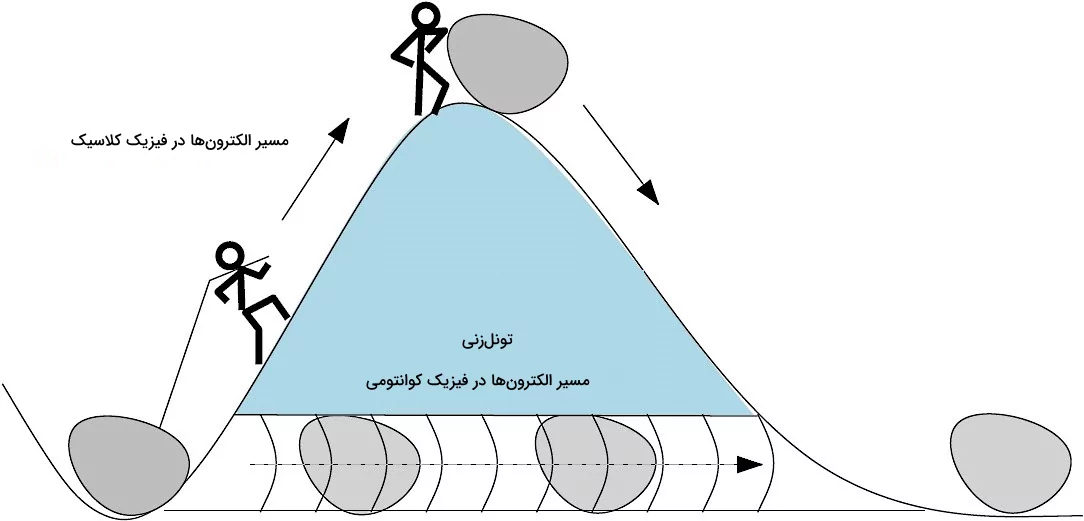

یکی از عواملی که باعث پیوند کامپیوتر و کوانتوم شد، کوچکتر شدن ابعاد اجزایی مانند پردازندههای محاسباتی بود. با وجود پیشرفتهای شگفتانگیز در کارایی و سرعت این قطعات، مسائل پیچیدهای وجود دارند که حل آنها از عهده هیچ یک از ابرکامپیوترهای موجود بر نمیآید. همچنین، یک مشکل اساسیتر در روند توسعه و ساخت تراشهها، کوچک شدن ابعاد ترانزیستورها است. ترانزیستور به زبان ساده نوعی کلید الکترونیکی است که عمل ذخیرهسازی و پردازش را در کامپیوترهای معمولی انجام میدهد. میدانیم حرکت الکترونها از یک مکان به مکان دیگر موجب برقراری جریان الکتریکی میشود. بنابراین هر مسیری که به نوعی از حرکت الکترونها در یک راستای مشخص جلوگیری کند، یک کلید یا Switch محسوب میشود.

از طرفی با توجه به اینکه در ساختارهای زیر ۱۰ نانومتر، ابعاد ترانزیستورها به ابعاد اتمی نزدیک میشود و در این ابعاد، قوانین فیزیک کوانتومی نمود بیشتری پیدا میکنند، پس با کوچکتر شدن ترانزیستورها، فیزیک کوانتومی قواعد بازی را عوض میکنند. در این شرایط یک الکترون میتواند طبق شکل زیر از یک ترانزیستور به ترانزیستور دیگر تونلزنی انجام دهد، که این پدیده برای یک تراشه محاسباتی، امر مطلوبی نیست. اما این چالش باعث نشد تا بگوییم دنیای پردازندهها به انتهای خود نزدیک شده است. راهحل پیشنهادی این بود که محاسبات را از دنیای کلاسیک به دنیای کوانتوم بیاوریم.

با نگاهی گذرا به روند پیشرفت علوم کامپیوتر و محاسبات، متوجه میشویم که در حال حاضر کامپیوترهای کوانتومی به گزینهای جدی برای انجام محاسبات تبدیل شدهاند. این تکنولوژی بر اساس مطالعات دو فیزیکدان و محقق شرکت «آی بی ام» (IBM) به نامهای «رالف لاندائور» (Rolf Landauer) و «کارلس بنت» (Charles H. Bennett) پایهگذاری شد. لاندائور در سال ۱۹۶۰ مطرح کرد که اطلاعات ماهیتی فیزیکی دارند و با توجه به قوانین فیزیکی میتوانند تغییر کنند. نتیجه این ایده لاندائور این بود که کامپیوترها، به علت دستکاری و تغییر اطلاعات (بیتها) باعث میشوند اتلاف انرژی داشته باشیم. دلیل گرم شدن قسمتهای پردازشی کامپیوتر، حتی اگر عملیات سنگینی انجام نداده باشند، همین نکته است.

بنت در سالهای بعد نشان داد که اگر کامپیوترها بتوانند عملیات پردازش را به شکلی برگشتپذیر انجام دهند، میتوانیم از این اتلاف انرژی تا حد زیادی جلوگیری کنیم. برگشتپذیر بودن محاسبات به این معنا است که با داشتن خروجی، بتوانیم به اطلاعات ورودی دست پیدا کنیم. راهحل این مسئله این است که از گیتهای برگشتپذیر استفاده کنیم. در نهایت، «دیوید دویچ» (David Deutsch) یکی از تاثیرگذارترین افراد در توسعه محاسبات کوانتومی، مبانی نظری و تئوری یک کامپیوتر کوانتومی را تشریح کرد.

در مجموع، کامپیوتر کوانتومی نوعی تکنولوژی جدید کامپیوتری است که با بکارگیری برخی از اصول کوانتومی مانند اصل برهمنهی، درهمتنیدگی و تداخل قابلیت انجام محاسبات پیچیدهتری را با سرعت خیلی بالاتر ارائه میدهد. با وجود اینکه در محاسبات کوانتومی هم از سیستم دو حالتی استفاده میشود، اما نحوه پردازش اطلاعات در این کامپیوترها متفاوت از نوع کلاسیکی یا کامپیوترهای معمولی است. برای اینکه بهتر متوجه شویم مبنای محاسبات کوانتومی در یک کامپیوتر کوانتومی چیست، اولین قدم یادگیری چهار اصل مهم مکانیک کوانتوم در این محاسبات است. سپس باید با مفهوم کیوبیت و تفاوت آن با بیتهای معمولی آشنا شویم که موضوع بخشهای بعدی است.

چگونه با فرادرس یاد بگیریم کامپیوتر کوانتومی چیست؟

پیش از شروع مباحث دیگر، در این بخش چند فیلم آموزشی از مجموعه فرادرس که با موضوع محاسبات کوانتومی تهیه شده است، به شما معرفی میشود. در صورت علاقه به یادگیری از طریق مشاهده فیلم، استفاده از این دورهها میتواند برای شما بسیار مفید باشد و در نتیجه، بهتر متوجه خواهید شد که یک کامپیوتر کوانتومی چیست و چگونه کار میکند:

- فیلم آموزش رایگان کامپیوتر کوانتومی چیست؟ + نحوه کار و ویژگیها فرادرس

- فیلم آموزش محاسبات کوانتومی فرادرس

- فیلم آموزش سیستم های کوانتومی درهم تنیده فرادرس

- فیلم آموزش نرم افزار متمتیکا – حل محاسبات کوانتومی با Mathematica فرادرس

تفاوت کامپیوتر معمولی با کامپیوتر کوانتومی چیست؟

برای اینکه بهتر متوجه شویم یک کامپیوتر کوانتومی چیست و چگونه کار میکند، ابتدا باید کامپیوترهای معمولی را بشناسیم که در مقام مقایسه با کامپیوتر کوانتومی، میتوانیم آنها را کامپیوتر کلاسیکی هم بنامیم. جدول زیر سه تفات مهم کامپیوتر کلاسیکی و کامپیوتر کوانتومی را نشان میدهد:

| کامپیوتر کلاسیکی | کامپیوتر کوانتومی | |

| ابعاد بیت | یک بعدی (بیت) | سه بعدی (کیوبیت) |

| تعداد گیتهای منطقی | سه عدد | شش عدد |

| جهت عملیات منطقی | برگشتناپذیر | برگشتپذیر |

در ادامه این بخش به توضیح بیشتر این تفاوتها خواهیم پرداخت. از دستگاههای پانچ کارت قدیمی گرفته تا ابرکامپیوترهای مدرن، تمام کامپیوترهای کلاسیکی به یک شکل عمل میکنند. روند انجام محاسبات در این کامپیوترها بهصورت متوالی است و ذخیرهسازی داده در آنها توسط بیتهای باینری یا دودویی انجام میشود، به این صورت که هر بیت نشاندهنده یک یا یک است. ترکیب این بیتها در قالب کدهای باینری یا دستکاری آنها با استفاده از عملگرهای منطقی، به ما این امکان را میدهد که از کامپیوترهای کلاسیکی برای انجام محاسبات پیشرفته استفاده کنیم.

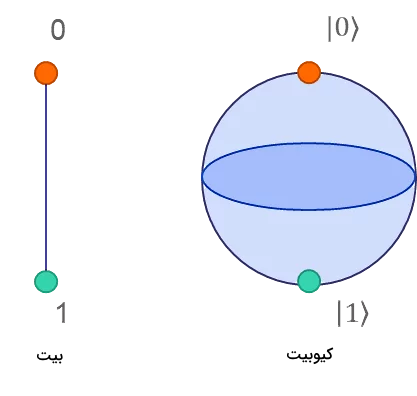

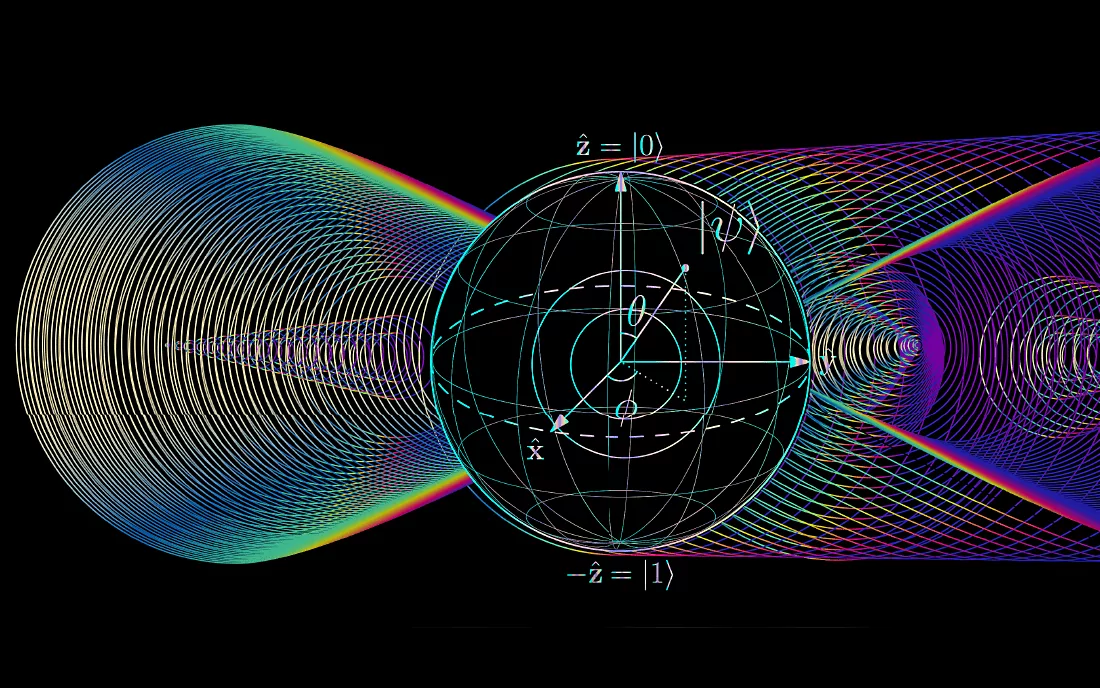

این در حالی است که یک کامپیوتر کوانتومی بر اساس اصول مکانیک کوانتومی کار میکند. این اصول توصیف کننده رفتار متفاوت ذرات زیراتمی در مقایسه با فیزیک ذراتی در ابعاد بزرگتر است. در سطوح زیراتمی، هر سیستمی یک سیستم کوانتومی محسوب میشود. کامپیوتر کوانتومی بهجای بیت از بیت کوانتومی یا کیوبیت استفاده میکند. اگر هر بیت را بهعنوان یک ساختار یک بعدی در نظر بگیریم، اولین و بنیادیترین تفاوت کامپیوتر کوانتومی و کلاسیکی در این است که کیوبیت دارای ساختاری سه بعدی به شکل زیر است:

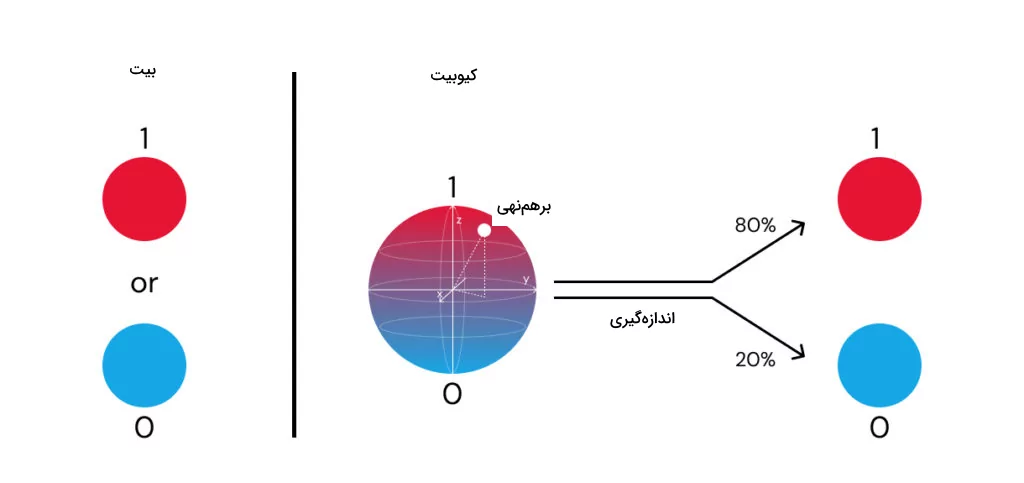

بیت کلاسیکی یا معمولی همواره در یکی از دو حالت یا دو قطب یا قرار دارد. اما در مورد کیوبیت، اگر جهت بالا را بهعنوان و جهت پایین را بهعنوان در نظر بگیریم، تا زمانی که اندازهگیری یا مشاهده انجام نشود، کیوبیت میتواند در هر نقطهای روی سطح یک کره ۳۶۰ درجه به شکل بالا (کره بلوخ) قرار بگیرد. اگر بخواهیم موقعیت دقیق کیوبیت را روی کره بلوخ نشان دهیم، باید ترکیبی از حالتهای و که در مکانیک کوانتومی با و نمایش داده میشوند را پیدا کنیم. ا

تفاوت دوم این دو نوع کامپیوتر در این است که این بیتها یا کیوبیتها چگونه پردازش میشوند. در یک کامپیوتر معمولی، اطلاعات بیتها بر اساس برنامه یا کد کامپیوتری داده شده به آن پردازش میشود. بنابراین ورودی به پردازنده وارد میشود و خروجی بر اساس قوانین پردازنده تولید میشود. اصولا سه گیت پایه داریم که تمام محاسبات کلاسیکی بر مبنای ترکیب آنها انجام میشود تا خروجی حاصل شود. این گیتها عبارتاند گیت AND، گیت OR و گیت NOT. حالا برای اینکه روند انجام چنین فرآیندی در یک کامپیوتر کوانتومی را بهتر درک کنید، این فرض را در نظر داشته باشید که عملیات پردازش در کامپیوتر کلاسیکی شبیه انجام بازی شطرنج با مهرههایی است که همه توانایی یک سرباز را دارند.

اما در کامپیوتر کوانتومی شش گیت پایه داریم که عبارتاند از گیت پاولی X، گیت پاولی Y، گیت پاولی Z، گیت هادمارد، گیت SWAP و گیت CNO. همچنین یکی از مهمترین اصول کوانتومی یعنی درهمتنیدگی را داریم که باعث میشود این گیتها به هم متصل شوند. بنابراین اگر به بازی شطرنجی که برای کامپیوتر کلاسیکی توصیف کردیم، بازگردیم، در مورد کامپیوتر کوانتومی برای تمام مهرهها امکانات وزیر را در اختیار داریم. پس دومین تفاوت این دو کامپیوتر در گیتهای پایهای است که برای انجام عملیات پردازش بکار میبرند.

آخرین تفاوت این دو کامپیوتر، در بازدهی منطقی محاسبات آنها است. اگر دقت کرده باشید، زمانی که با یک کامپیوتر کلاسیکی زیاد کار میکنید، صدای فن یا گرم شدن کامپیوتر را احساس خواهید کرد. پردازش در کامپیوترهای کلاسیکی همراه با اتلاف اطلاعات در قالب گرما است. علت این است که گیتهای منطقی در این کامپیوترها در یک جهت عمل میکنند، یعنی زمانی که محاسبات در یک گیت انجام میشود، نمیتوانید خروجی را در جهت عکس روی گیت اعمال کنید تا ورودی اولیه را بهدست آورید.

اما گیتهای کوانتومی دو جهتی عمل میکنند، به این معنا که میتوان هر خروجی را در جهت معکوس روی گیت اعمال کرد تا به ورودی اولیه رسید. پس عملگرهای محاسبات کلاسیکی یک جهته و برگشتناپذیراند، در حالی که عملگرهای کوانتومی دو جهته و برگشتپذیر هستند. این ویژگی عملگرهای کوانتومی در کنار دو ویژگی متمایز دیگری که توضیح دادیم، باعث میشود اطلاعات خیلی بیشتری در هر عملیات پردازش شود و در نتیجه سرعت بالاتری برای این کامپیوترها داشته باشیم.

اصول کوانتومی حاکم بر عملکرد یک کامپیوتر کوانتومی چیست؟

درک بهتر محاسبات کوانتومی و نحوه عملکرد یک کامپیوتر کوانتومی زمانی میسر میشود که با اصول کوانتومی حاکم بر آن آشنا باشید. این اصول عبارتاند از:

- «برهمنهی» (Superposition)

- «درهمتنیدگی» (Entanglement)

- «ناهمدوسی» (Decoherence)

- «تداخل» (Interference)

در ادامه این بخش هر کدام این موارد را توضیح میدهیم. در کنار این اصول، تعاریف دیگری مانند تعریف «ذرات کوانتومی» (Quantum Particles) نیز مهم هستند. ذرات کوانتومی، کوچکترین اجزای سازنده جهان فیزیکی محسوب میشوند. فوتونها، الکترونها، یونهای به دام افتاده و اتمها همگی نمونههایی از ذرات کوانتومی محسوب میشوند.

اصل برهمنهی در مکانیک کوانتومی چیست؟

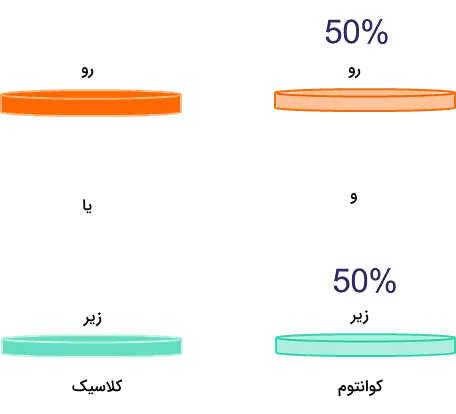

ابتدا توضیح میدهیم اثر برهمنهی در تعامل کیوبیتها و در نتیجه، عملکرد یک کامپیوتر کوانتومی چیست. برهمنهی حالتی است که در آن یک ذره یا سیستم کوانتومی میتواند نهتنها یک احتمال، بلکه ترکیبی از چندین احتمال را نشان دهد. در تصویر زیر ملاحظه میکنید که دیدگاه فیزیک کوانتوم با در نظر گرفتن اصل برهمنهی، چه تفاوتی با دیدگاه فیزیک کلاسیک دارد.

در این تصویر نتایج حاصل از پرتاب یک سکه از دید کوانتومی و کلاسیکی بررسی شده است و طبق آن، دید کلاسیکی با احتمال ۱۰۰٪ میگوید که یا سکه زیر است و یا رو. اما دید کوانتومی میگوید وضعیت نهایی سکه یک ترکیب خطی است از مجموع ۵۰٪ احتمال رو و ۵۰٪ احتمال زیر.

در حقیقت دیدگاه کوانتومی حالتی را که در آن سکه در هوا معلق و در حال چرخش است، نیز در نظر میگیرد. پس پیش از اندازهگیری یا مشاهده نهایی، برهمنهی کوانتومی اجازه میدهد تا حالت کوانتومی سکه ترکیب خطی از دو یا تعداد بیشتری از حالتهای کلاسیکی باشد. بنابراین حالت برهم نهی، حالت قطعی و نهایی در این اندازهگیری نیست. این تعریف کلی اصل برهمنهی در فیزیک کوانتوم است. اما باید ببینیم کاربرد این اصل در یک کامپیوتر کوانتومی چیست. زمانی که یک کیوبیت در حالت صفر یا یک قرار دارد، تفاوت چندانی ایجاد نمیکند، اما اگر در حالتی به نام حالت برهمنهی قرار داشته باشد، میتواند در افزایش سرعت محاسبات کوانتومی نقش مهمی ایفا کند.

حالت برهمنهی ترکیبی از تمام حالتهای ممکن برای یک کیوبیت، یعنی ترکیبی از و است. به این ترتیب، گروهی از کیوبیتهایی که در حالت برهمنهی قرار دارند، میتوانند یک فضای محاسباتی چند بعدی و پیچیده بسازند. چنین فضایی میتواند مسائل پیچیده محاسباتی را به روشهای جدید حل کند. همچنین برهمنهی کیوبیتها باعث میشود در کامپیوترهای کوانتومی ویژگی مهمی به نام موازیسازی ذاتی داشته باشیم. در نتیجه یک کامپیوتر کوانتومی این قابلیت را دارد که تعداد خیلی خیلی زیادی داده را همزمان پردازش کند.

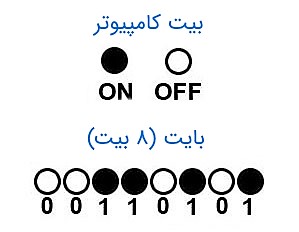

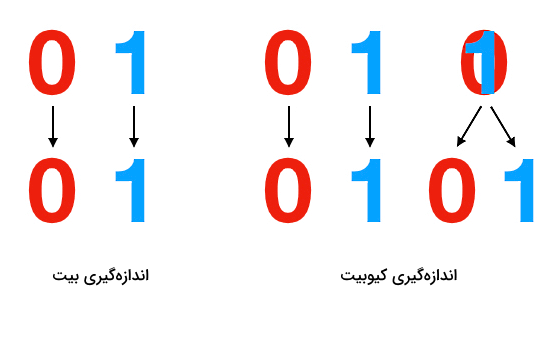

تصویر بالا تفاوت بیت معمولی و بیت کوانتومی را در حالت برهمنهی نشان میدهد. اگر به بیت معمولی دقت کنید، این نوع بیت با احتمال ۱۰۰٪ یا در حالت است یا در حالت . اما یک کیوبیت در حالت برهمنهی و پیش از اندازهگیری، میتواند همزمان هم و هم باشد (با احتمال مشخص برای هر کدام). برای نشان دادن حالت یک کیوبیت از یک تابع موج ریاضیاتی به نام (روش نامگذاری دیراک در کوانتوم) استفاده میشود. احتمالی را توصیف میکند که یک کیوبیت میتواند در یک حالت خاص قرار بگیرد. برای مثال احتمال اینکه کیوبیت در حالت برهمنهی باشد، برابر است با:

معمولا ضرایب و اعداد مختلط هستند. پس از اندازهگیری، طبق شکل با احتمالی به اندازه حالت و با احتمالی برابر با حالت را دریافت خواهیم کرد.

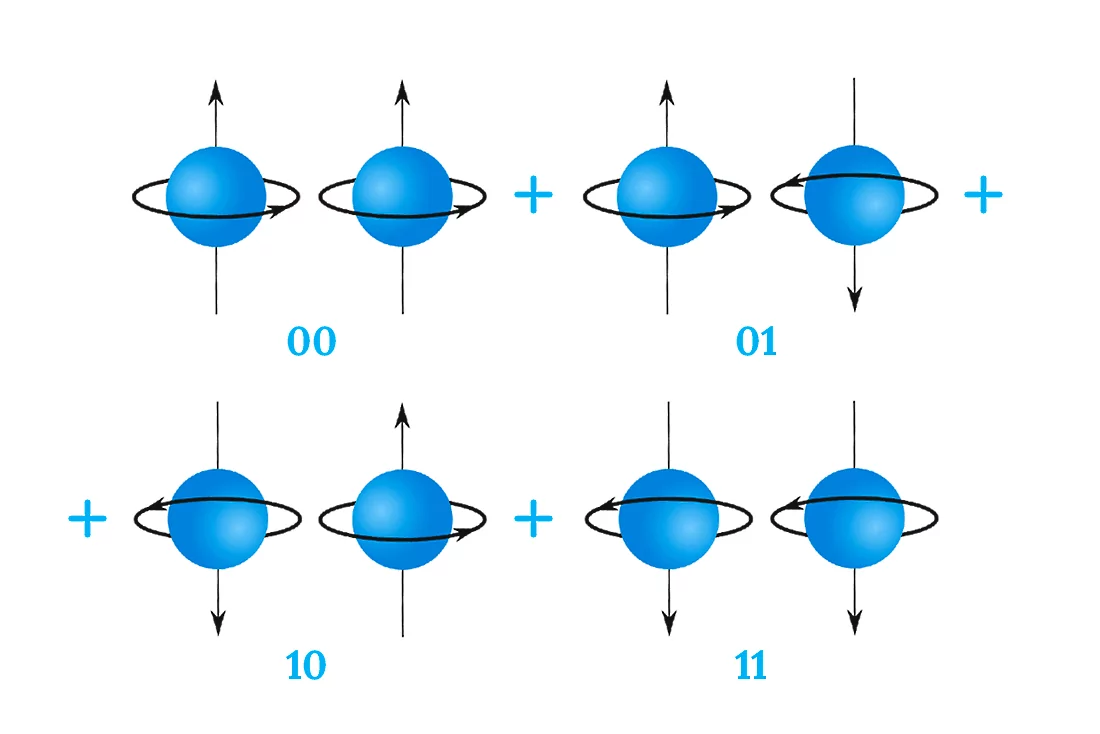

درهمتنیدگی کوانتومی چیست؟

درهمتنیدگی در کوانتوم فرآیندی است که در آن چند ذره کوانتومی با قدرت بسیار زیادی در مقایسه با آنچه که احتمالات پیشبینی میکنند، به هم مرتبط یا همبسته میشوند. این همبستگی به گونهای است که نمیتوانیم حالت کوانتومی هر کدام از این ذرات را مستقل از سایر ذرات بررسی کنیم. فرادرس، یک دوره آموزشی جامع را با عنوان «فیلم آموزش سیستم های کوانتومی درهم تنیده» تهیه کرده است که میتواند مسیر یادگیری این مفهوم را برای شما هموار کند. لینک مشاهده این فیلم در ادامه آورده شده است:

زمانی که دو سیستم کوانتومی در همتنیده میشوند، اگر یکی از این دو را بتوان مشاهده یا اندازهگیری کرد، حالت دیگری نیز کاملا با اولین سیستم همبسته است، صرفنظر از اینکه چقدر از آن فاصله داشته باشد. برای مثال فرض کنید یک سیستم کوانتومی مانند دو الکترون درهمتنیده دارید. اگر یکی از الکترونهای چنین سیستمی در حالتی با اسپین بالا مشاهده شود، الکترون درهمتنیده آن همواره در حالتی با اسپین پایین خواهد بود.

در مورد یک کامپیوتر کوانتومی، درهمتنیدگی به توانایی یک کیوبیت برای همبسته کردن حالتاش با سایر کیوبیتها گفته میشود. سیستمهای درهمتنیده بهصورت ذاتی به هم متصل هستند. این اتصال به نحوی است که برای مثال، زمانی که یک پردازشگر کوانتومی فقط یک کیوبیت درهمتنیده را اندازهگیری میکند، بلافاصله اطلاعات سایر کیوبیتهایی که در آن سیستم درهمتنیده وجود دارند نیز تعیین میشود. به این ترتیب، اندازهگیری یک سیستم کوانتومی به معنای تغییر حالت آن از حالت برهمنهی کوانتومی به حالت دوتایی یا باینری یعنی یک یا یک است.

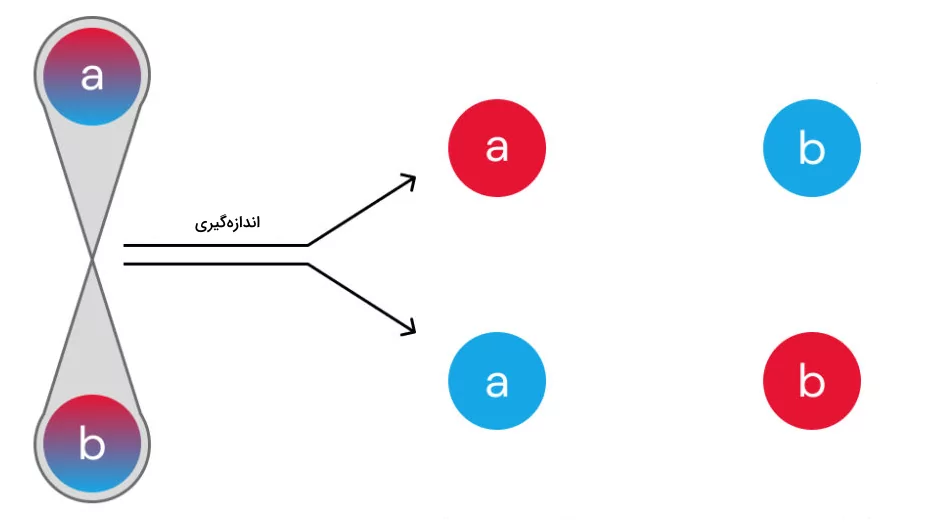

اگر بخواهیم در مورد درهمتنیدگی دقیقتر فکر کنیم، این مفهوم فرم ویژهای از برهمنهی کوانتومی محسوب میشود که در آن پس از اندازهگیری، خروجیها بر اساس همبستگی قوی بین اجزای سیستم درهمتنیده تعیین میشوند. برای مثال، تصویر بالا دو کیوبیت درهمتنیده شده به نام و را نشان میدهد که پس از اندازهگیری، اگر قرمز باشد، حتما آبی است و اگر آبی مشاهده شود، حتما قرمز است.

ناهمدوسی کوانتومی چیست؟

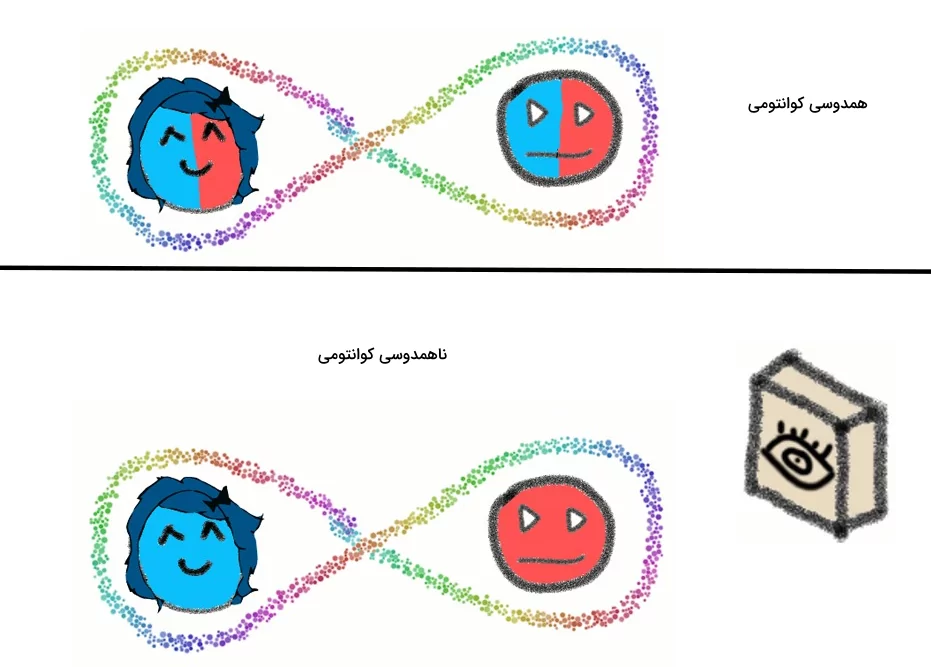

تا اینجا آموختیم دو اصل کوانتومی مهم جهت درک بهتر نحوه عملکرد یک کامپیوتر کوانتومی چیست. ناهمدوسی فرآیندی است که در آن ذرات یا سیستمهای کوانتومی دچار واپاشی یا تغییر شده و به حالتهای مجزایی تبدیل میشوند که با قوانین فیزیک کلاسیک قابلاندازهگیری است. در بخش قبل توضیح دادیم که منظور ما از اندازهگیری در یک کامپیوتر کوانتومی چیست. گفتیم اندازهگیری یک سیستم کوانتومی یعنی تغییر حالت آن از یک برهمنهی از تمام حالتهای ممکن به یکی از دو حالت کوانتومی صفر یا یک.

اما اگر به هر دلیلی سیستم کوانتومی به یک حالت غیرکوانتومی یا کلاسیکی تغییر حالت دهد، در این صورت ناهمدوسی داریم. برای مثال، در تصویر بالا مشاهده میکنید که در حالت ناهمدوسی حالتهای سیستم کاملا مجزا شدهاند در حالی که در همدوسی حالتها از هم جدا نبودند. بنابراین باید دقت کنیم که حالتهای باینری یا ، حالتهای کلاسیکی محسوب نمیشوند و کوانتومی هستند. قطعا ناهمدوسی برای یک کامپیوتر کوانتومی مطلوب نیست، چون با کلاسیکی شدن حالت سیستم امکانات قبل وجود ندارد. ناهمدوسی ممکن است در اثر نویزهای مختلفی مانند دما یا نوسان ایجاد شود. از طرفی، ناهمدوسی اجازه میدهد یک کامپیوتر کوانتومی بتواند با یک کامپیوتر کلاسیکی ارتباط برقرار کند.

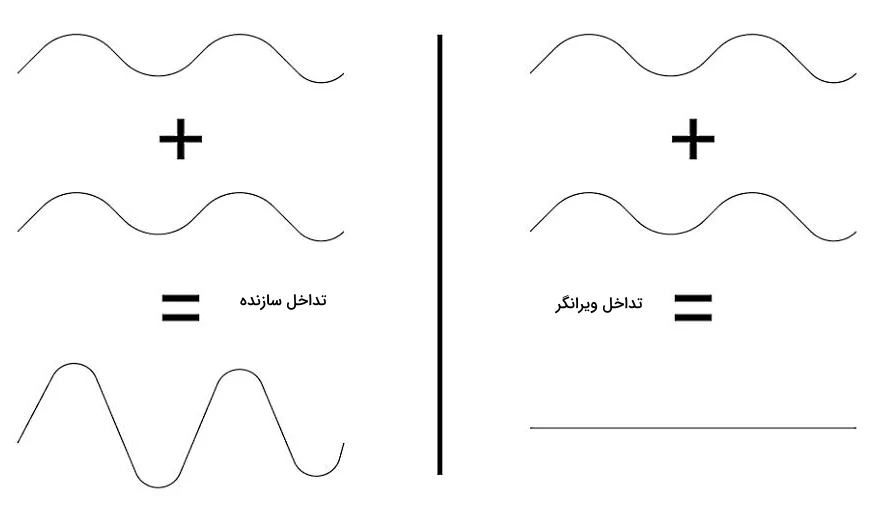

تداخل در کوانتوم چیست؟

تداخل در مکانیک کوانتوم پدیدهای است که از ماهیت موجگونه حالتهای کوانتومی بهوجود میآید. در بخش برهمنهی نشان دادیم که هر حالت کوانتومی دارای یک ضریب عددی مختلط به نام دامنه است. مجذور این دامنه، احتمال اندازهگیری یا مشاهده آن حالت را تعیین میکند. چنین اصولی در مکانیک کوانتوم اجازه میدهند تا بتوانیم احتمالات را با هدف افزایش شانس دریافت خروجیهای موردنظر یا حذف احتمالات ناخواسته، دست کاری کنیم. بنابراین در تداخل کوانتومی احتمال مشاهده خروجیهای مختلف میتواند در اثر فازهای نسبی حالتهای کوانتومی درگیر، افزایش یا کاهش پیدا کند.

زمانی که یک برهمنهی از حالتهای کوانتومی داریم، فازهای نسبی (یا زاویه) بین این حالتها است که تعیین میکند وضعیت مجموع دامنه این حالات چگونه است. اگر دامنهها یکدیگر را تقویت کنند، تداخل سازنده داریم. در غیر این صورت، تداخل ویرانگر است:

- تداخل سازنده: احتمال بالاتری برای وقوع یک خروجی خاص بهدست میآید.

- تداخل ویرانگر: احتمال کمتری برای وقوع یک خروجی خاص بهدست میآید.

تداخل در یک کامپیوتر کوانتومی به این صورت است که حالتهای کوانتومی درهمتنیده شده میتوانند با هم برهمکنش کنند و در نتیجه، احتمالات جدیدی تولید شود. کیوبیتهای درهمتنیده شده میتوانند در یک حالت برهمنهی جمعی شبیه به امواج قرار بگیرند، به گونهای که دامنه این امواج با هر یک از خروجیها متناظر است. در حقیقت، این دامنهها همان احتمالات خروجیهایی هستند که از اندازهگیری سیستم حاصل شده است.

حالا شرایطی را فرض کنید که تعداد خیلی زیادی از این امواج داریم و در اثر برهمکنش قلهها و درههای این امواج، بخشی از آنها یکدیگر را تقویت و برخی دیگر یکدیگر را حذف میکنند. در هر دو حالت، چه احتمالات هم را تقویت کرده و افزایش دهند و چه یکدیگر را حذف کنند یا کاهش دهند، نوعی تداخل داریم. الگوریتمهای کوانتومی با بهرهگیری از این اثر میتوانند پاسخهای اشتباه در محاسبات را حذف کنند و در نتیجه با این روش، علاوه بر افزایش سرعت محاسبات کوانتومی پاسخهای صحیح را با احتمال بیشتری بهدست خواهیم آورد.

کیوبیت چیست؟

همانطور که مبنای ذخیرهسازی و پردازش دادهها در کامپیوترهای کلاسیکی بیتها یا و ها است، انتظار داریم در کامپیوترهای کوانتومی هم سیستم مشابهی وجود داشته باشد. بیتهای کلاسیکی در کامپیوترهای کلاسیکی مرسوم جای خود را به بیتهای کوانتومی یا «کیوبیت» (Qubit) در کامپیوترهای کوانتومی میدهند. مزیت این جایگزینی این است که یک کامپیوتر کوانتومی با استفاده از این بیتهای کوانتومی قادر است همزمان دادههای خیلی بیشتری را در فرآیند برهمنهی کوانتومی رمزگذاری کند.

بنابراین یک کیوبیت یا یک بیت کوانتومی معادل است با واحد پایه اطلاعات در محاسبات کوانتومی، که به منظور رمزگذاری دادهها استفاده میشود. عملکرد کیوبیت کاملا با عملکرد همتای خود در کامپیوترهای کلاسیکی یعنی بیتهای سنتی یا دودویی که برای رمزگذاری اطلاعات بکار میرفتند، معادل است. یعنی کیوبیت میتواند مانند بیت رفتار کرده و یک یا یک را ذخیره کند. علاوهبر این، کیوبیت میتواند بهصورت همزمان یک ترکیب وزنی از و نیز باشد.

واژه کیوبیت توسط یک فیزیکدان نظری آمریکایی به نام «بنجامین شوماخر» (Benjamin Schumacher) مطرح شد. بهطور کلی، کیوبیتها با اعمال تغییرات، دستکاری و اندازهگیری ذرات کوانتومی مانند فوتونها، اتمهای خنثی یا یونهای به دام افتاده ایجاد میشوند. برای اینکه بتوانیم ذرات کوانتومی را دستکاری کنیم، لازم است کیوبیتها تا حد امکان سرد شوند. سردسازی کیوبیتها باعث میشود نویز حداقل شود و در نتیجه، از ارائه نتایج تقریبی که دقیق نیستند یا خطای ناشی از ناهمدوسی ناخواسته جلوگیری شود. همچنین میتوان کیوبیتها را با هدف مهندسی سیستمهایی که مانند یک ذره کوانتومی رفتار میکنند (برای مثال مدارهای ابررسانا) بکار برد. نکته مهم راجعبه کاربرد کیوبیتها در کامپیوترهای کوانتومی این است که علاوهبر پیروی از قواعد کوانتومی، باید بتوانند در یک برهمنهی کوانتومی وجود داشته باشند. این نکته باعث میشود بیتهای کوانتومی تفاوت ویژهای با بیتهای کلاسیکی داشته باشند.

اگر بخواهیم بدانیم منشا مزیت ویژه یک کامپیوتر کوانتومی چیست، باید این تفاوت مهم را بدانیم که یک بیت کلاسیکی فقط میتواند در یکی از دو حالت یا وجود داشته باشد، اما یک کیوبیت علاوهبر این دو حالت، میتواند با بهرهگیری از اصل برهمنهی کوانتومی در حالت سومی به نام برهمنهی نیز وجود داشته باشد. یک برهمنهی میتواند ، و تمام موقعیتهایی که همزمان بین و گرفته شدهاند را نشان دهد. کیوبیتها علاوهبر رمزگذاری سه موقعیت جداگانه، میتوانند برای انتقال اطلاعات از یک سیستم باینری نیز بکار روند. در چنین سیستمهایی کلمه بیت به هر ماده یا فرآیندی گفته میشود که برای نمایش یا یا برای اندازهگیری آن بیت استفاده میشود.

ترکیب کیوبیتها بر اساس اصل برهمنهی و بهصورت تصاعدی است. در نتیجه با ترکیب کیوبیتها مقیاس افزایش مییابد، به این صورت که طبق شکل زیر، برای کیوبیت به حالت نیاز است، برای کیوبیت به حالت، برای کیوبیت به حالت و به همین ترتیب. با این وجود در انتهای محاسبات، هر کیوبیت تنها دارای یک تک بیت اطلاعات بهعنوان خروجی است.

در کنار امتیازات ویژهای که کیوبیت به کمک اصول مکانیک کوانتومی ارائه میدهد، چالشهایی نیز در مورد آن وجود دارد. مهمترین چالش در مسئله سردسازی این نوع از بیتها است، چرا که لازم است تا کمی (کسری از یک درجه سانتیگراد) بالاتر از صفر مطلق سرد شوند. این دما از دمای فضای بیرون کامپیوتر کوانتومی سردتر است، در نتیجه فراهم کردن چنین شرایطی آسان نیست. چالش بعدی به اثر سردسازی روی ناهمدوسی کوانتومی ذارت کوانتومی مربوط است.

همچنین هر ذره کوانتومی در یک کامپیوتر کوانتومی دارای خاصیتی به نام همدوسی است، تا زمانی که به نحوی تحت کنترل باشد که بتواند به صورت یک کیوبیت عمل کند. اگر کیوبیتی این توانایی خود را از دست بدهد، آن را با ناهمدوسی توصیف میکنیم. در چنین شرایطی به سیستمهای سرد کننده با قدرت بالا نیاز داریم تا حالتی از همدوسی برای داشتن کیوبیتهای قابل کاربرد ایجاد کنند. البته حتی در خنکترین شرایط هم سیستمهای کیوبیت عموما مستعد شکست بر اثر ناهمدوسی هستند. در این زمینه پیشرفتهای قابل توجهی با ظهور شاخه جدیدی به نام اصلاح خطای کوانتومی الگوریتمی بهدست آمده است که قابلیت پایدارسازی سیستمهای کوانتومی ضعیف قبلی را ارائه میدهند.

در انتهای این بخش با توجه به اینکه تا اینجا با مفاهیمی مانند درهمتنیدگی و کیوبیت تا حدی آشنا شدهاید، میخواهیم ببینیم اصل درهمتنیدگی در یک کامپیوتر کوانتومی چگونه کار میکند. در یک کامپیوتر کوانتومی، این اصل به معنای درهمتنیدگی دو کیوبیت (یا هر دو ذره یا تعداد بیشتری از ذرات کوانتومی) است، به گونهای که فارغ از فاصله بین ذرات، حالت هر ذره مستقل از سایر ذرات قابل توصیف نباشد. بنابراین هر زمان که دو کیوبیت درهمتنیده شوند، هر دو همزمان در حالت برهمنهی هم قرار دارند.

این شرایط تا زمانی برقرار است که یکی از آنها اندازهگیری شود. به محض اینکه اندازهگیری یا مشاهده انجام شد، برهمنهی کوانتومی از بین میرود و آن کیوبیتی که اندازهگیری یا مشاهده نشده است، در موقعیتی مخالف موقعیت کیوبیت اندازهگیری شده فرض میشود. برای مثال، اگر نصف یک جفت کیوبیت درهمتنیده شده در حالت مشاهده شود، حالت کیوبیت دیگر فورا برابر با اندازهگیری میشود. این در حالی است که بیتهای کلاسیکی درهمتنیده نمیشوند. بنابراین کیوبیتهای کوانتومی در همتنیده (نه کیوبیتهای معمولی) میتوانند اطلاعات را بهصورت آنی و با سرعتی بیشتر از سرعت نور انتقال دهند و اثر درهمتنیدگی کوانتومی، افزایش قدرت مدارهای کوانتومی است.

تفاوت بیت و کیوبیت چیست؟

در این بخش توضیح میدهیم که اثر تفاوت بیت و کیوبیت روی عملکرد متمایز یک کامپیوتر کوانتومی چیست. در کامپیوترهای کلاسیکی، یک بیت به هر جزء از اطلاعات دوتایی گفته میشود که بهصورت یا نوشته میشود. همچنین در این کامپیوترها، عموما بیت با یک پالس جریان یا ولتاژ نمایش داده میشود. در این سیستمها، وقتی که هیچ جریانی نداریم، مدار در حالت خاموش یا OFF قرار دارد و چنین حالتی با نشان داده میشود. به محض اینکه جریان برقرار شد، مدار روشن یا ON است و در حالت هستیم.

بنابراین فرقی نمیکند در حال ضبط یک ویدئوی دیجیتالی هستید، در حال انیمیشنسازی یک مدل سه بعدی هستید یا در حال محاسبه با یک اپلیکیشن محاسباتی، در تمام این موارد دادهها بهصورت کدهای باینری یا دودویی و به نرمافزار منتقل میشوند. در نتیجه یک مجموعه بیت داریم که برای دستهبندی و درک بهتر آنها از واحد بزرگتری به نام «بایت» (Byte) استفاده میشود. هر بایت از هشت بیت ساخته میشود که معادل است با حداقل تعداد بیتهای موردنیاز جهت انتقال باینری سیگنالی با مشخصه متنی. رشتههایی طولانی از این و ها میتوانند برای برای ذخیره هر عدد، نماد و حروفی استفاده شوند. به طور مثال در قواعد کد «اسکی» (ASCII) رشته برای نمایش و رشته برای نمایش به کار میرود.

پس هر سیستم دو حالتهای که بتوانیم حالت آن را فقط با یکی از دو موقعیت ممکن توصیف کنیم (برای مثال، بالا یا پایین، چپ یا راست، روشن یا خاموش)، میتواند جهت نمایش بیت استفاده شود. با اینکه مبنای تکنولوژی کامپیوترهای کوانتومی کدهای باینری است، اما دادههای کوانتومی استخراج شده از یک سیستم کوانتومی مانند یک کیوبیت، به روش متفاوتی دادهها و اطلاعات را رمزنگاری میکنند. پژوهشگران این حوزه روشهای مختلفی را جهت ایجاد کیوبیت یا استفاده از سیستمهای کوانتومی طبیعی بهعنوان کیوبیت پایهگذاری کردهاند. با این وجود در اغلب موارد، کامپیوترهای کوانتومی برای جداسازی کیوبیتها و جلوگیری از تداخل آنها به سردسازی نیازمندند.

در تئوری، هر سیستم کوانتومی دو حالتی میتواند برای ساخت یک کیوبیت استفاده شود. زمانی یک سیستم کوانتومی دو حالتی است که بتوانیم ویژگیها و خواص سیستمی خاصی از آن را در موقعیتهای باینری اندازهگیری کنیم، برای مثال بالا یا پایین. البته از سیستمهای کوانتومی چند حالته نیز با شرایط خاصی میتوانیم برای تولید کیوبیت استفاده کنیم. یک سیستم کوانتومی چند حالته تا زمانی برای تولید کیوبیت بکار میرود که دو جنبه یا دو حالت از آن بهطور موثری از هم جدا شده باشند، به گونهای که یک اندازهگیری باینری تولید شود.

همانطور که کامپیوترهای سنتی میتوانند از انواع مختلفی از بیتها مانند جریان الکتریکی، بار الکتریکی و حفرههای ایجاد شده در کارت پانچ استفاده کنند، قابلیت استفاده از انواع مختلف بیتها برای یک کامپیوتر کوانتومی نیز وجود دارد. البته برخی از انواع بیتها بهمنظور کاربرد در عملکرد خاصی ممکن است مناسبتر باشند، به همین دلیل در یک کامپیوتر کوانتومی پیشرفته اغلب از ترکیبی از انواع بیتها برای دستیابی به عملکردهای مختلف استفاده میشود.

در حالی که هر بیت میتواند نشاندهنده یک یا یک باشد، یک کیوبیت میتواند یک ، یک یا یک برهمنهی از آنها را نمایش دهد. برهمنهی میتواند هر سه حالت ، و تمام حالتهای ممکن بین و را توصیف کند. در حقیقت اصل برهمنهی نمایشگر احتمالی از حالتهای کیوبیت است. پس منشا تفاوت بیت و کیوبیت به اصل برهمنهی در کوانتوم و استفاده از مفاهیم احتمالات بازمیگردد.

در سطوح کوانتومی، احتمال کیوبیت در قالب یک تابع موج اندازهگیری میشود که از دامنه این احتمال برای رمزگذاری بیشتر از یک بیت داده میتوان استفاده کرد. به این ترتیب، ترکیب چنین کیوبیتی با سایر کیوبیتها در انجام محاسبات بسیار پیچیده مفید است. زمانی که مسائل پیچیدهای مانند فاکتورگیری یک عدد اول بسیار بزرگ، توسط یک کامپیوتر کوانتومی پردازش میشود، بیتهای سنتی با نگه داشتن مقادیر زیادی اطلاعات در کنار هم قرار میگیرند. اما بیتهای کوانتومی متفاوت عمل میکنند، این بیتها فقط یک برهمنهی را نگه میدارند. به این ترتیب، یک کامپیوتر کوانتومی با استفاده از کیوبیت قادر است حجم خیلی بالاتری از داده را محاسبه و پردازش کند.

این بخش را با مثال ملموستری از تفاوت بیت و کیوبیت به پایان میرسانیم. فرض کنید در مرکز یک مسیر مارپیچ ایستادهاید. برای فرار از این وضعیت، یک کامپیوتر سنتی ترکیبی از مسیرهای مختلف را بهعنوان راهحل به شما پیشنهاد میدهد تا بتوانید راه خروج را پیدا کنید. این کامپیوتر با استفاده از بیتها مسیرهای جدید را کشف کرده و همزمان این قدرت را دارد که به خاطر بسپارد کدام مسیر به خروج منتهی نشد.

در مقایسه، پردازش در یک کامپیوتر کوانتومی بهگونهای است که میتواند مانند یک پرنده دید کلی از این مسیر پیچیده بهدست آورد و همزمان مسیرهای مختلف را نیز امتحان کند تا به مسیر درست برسد. کیوبیتها به آزمایش همزمان مسیرهای مختلف نمیپردازند، بلکه در این کامپیوترها دامنه احتمالات کیوبیتها اندازهگیری میشود تا خروجی صحیح محاسبه شود. عملکرد این دامنهها مانند یک موج است، به این شکل که میتوانند مانند امواج با هم تداخل یا همپوشانی داشته باشند. همپوشانی امواج غیرهمزمان، آسنکرون یا Asynchronous بهطور موثری موجب حذف راهحلهایی میشود که مسئله را پیچیده میکند و در نتیجه، موج یا امواج همدوس نتیجه شده راهحل درست هستند.

انواع کیوبیت و تکنولوژیهای کوانتومی

در بخشهای قبل یاد گرفتیم کیوبیت چیست، چه تفاوتی با بیت دارد و اثر آن در عملکرد یک کامپیوتر کوانتومی چیست. همچنین اشاره کردیم که میتوان از هر نوع سیستم دو حالته کوانتومی برای تولید کیوبیت استفاده کرد. آشناترین سیستمهای دو حالتهای که در مکانیک کوانتوم میشناسیم، عبارتاند از اسپین الکترون و نور قطبیده شده. بر این اساس، انواع مختلفی از کیوبیتها توسط پژوهشگران توسعه داده شدهاند، به گونهای که هر نوع برای کاربرد خاصی مناسب است و وظیفه ویژهای دارد. انواع مختلف کیوبیت عبارتاند از:

- کیوبیتهای ابررسانا

- یونهای به دام افتاده

- نقاط کوانتومی

- فوتونها

- اتمهای خنثی

نکته مهم این است که هنوز روش ساخت بهینهترین کامپیوتر کوانتومی ارائه نشده است و چندین کمپانی و گروه تحقیقاتی در حال بررسی انواع مختلف کیوبیت هستند. در ادامه راجعبه تکنولوژی انواع کیوبیت توضیحات مختصری ارائه میشود.

کیوبیتهای ابررسانا

کیوبیتهای ابررسانا یا Superconducting از موادی ساخته میشوند که دارای خاصیت ابررسانایی هستند. ابررسانایی خاصیتی است که در مواد خاصی (مانند جیوه و هلیوم) و در دماهای خیلی پایین مشاهده میشود. مقاومت این مواد در دماهایی کمتر از دمایی به نام دمای بحرانی برابر است با صفر. در نتیجه جریان الکتریکی عبوری از یک حلقه سیم ابررسانا بهصورت نامحدود و بدون نیاز به منبع، برقرار است.

محاسبات کوانتومی ابررسانا معادل است با استفاده از یک کامپیوتر کوانتومی در مدارهای الکترونیکی ابررسانا. کیوبیتهای ابررسانا توسط این مدارهای الکترونیکی ابررسانا که در دماهای کرایوژنیک کار میکنند، ساخته میشوند. در حقیقت، با توجه به خواص ابررسانایی، عملکرد صحیح این کیوبیتها در دماهای خیلی پایین است. این نوع کیوبیتها توسط سیگنالهای ریزموج یا ماکروویو دستکاری میشوند و از این جهت مورد علاقه دانشمندان حوزه کامپیوتر کوانتومی محسوب میشوند که دارای همدوسی نسبتا قوی هستند. همچنین سرعت بالای این نوع کیوبیتها در انجام و کنترل محاسبات از دیگر مزایای این کیوبیتها است.

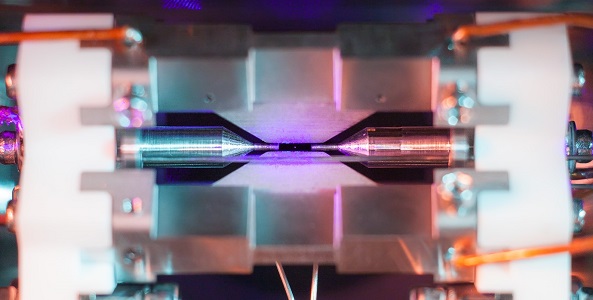

یونهای به دام افتاده

دومین نوع از انواع کیوبیت که در این بخش معرفی میشود، یونهای به دام افتاده یا Trapped ions هستند. با استفاده از تکنولوژیهای پیشرفته لیزری، ذرات یونی به دام افتاده نیز میتوانند بهعنوان کیوبیت استفاده شوند. از این نوع کیوبیت در زمانهای همدوسی طولانی یا در شرایطی که اندازهگیریهای با اطمینان بالا موردنیاز است، استفاده میشود. با اضافه کردن یا کندن الکترون از اتم، اتم به یون تبدیل میشود. این اتم میتواند در داخل یک کاواک به وسیله پالسهای لیزری به دام افتاده و در حالت خاصی قرار بگیرد.

یک کامپیوتر کوانتومی ساخته شده بر پایه گیتهای کوانتومی ابزاری است که دادههای ورودی را دریافت و بر اساس یک عملیات منطقی واحد و از پیش تعریف شده، آنها را منتقل میکند. چنین عملیاتی اغلب توسط یک مدار کوانتومی نمایش داده میشود. به این ترتیب یک کامپیوتر کوانتومی ساخته شده بر مبنای یونهای به دام افتاده و بر پایه گیت کوانتومی، از کیوبیتهایی استفاده میکند که معادلاند با حالتهای الکترونیکی اتمهای باردار یا یونها. برای ساخت تلههایی با این ابعاد جهت به دام افتادن یونها لازم است از میدانهای الکترومغناطیسی استفاده شود.

نقاط کوانتومی

«کوانتوم داتها یا نقاط کوانتومی» (Quantum Dots) دسته دیگری از کیوبیتها هستند. کوانتوم دات نوعی نیمهرسانا با ابعاد خیلی کوچک است که توانایی گرفتن یک تک الکترون و استفاده از آن بهعنوان یک کیوبیت را دارد. کیوبیتهای کوانتوم دات را میتوان با استفاده از میدان مغناطیسی دستکاری کرد. این نوع از کیوبیتها از نظر سازگاری و قابلیت مقایسه با سایر فناوریهای نیمهرسانا برای پژوهشگران این حوزه جذاب هستند.

فوتونها

نوع دیگری از کیوبیتها که در کامپیوترهای کوانتومی استفاده میشوند، فوتونها هستند. با تنظیم و اندازهگیری حالتهای اسپینی هر کدام از ذرات نور، کیوبیتهای فوتونی میتوانند برای ارسال اطلاعات در فواصل طولانی از طریق کابلهای فیبر نوری بکار روند و در حال حاضر نیز در ارتباطات و رمزنگاری کوانتومی کاربرد گستردهای دارند.

در همین راستا، یک پردازشگر کوانتومی فوتونیکی ابزاری است که نور را با هدف انجام محاسبات کوانتومی دستکاری میکند. کامپیوتر کوانتومی فوتونیکی از منابع نور کوانتومی استفاده میکند که پالسهای نوری فشرده گسیل میکنند و کیوبیت با مد عملگر پیوستهای مانند مکان یا مومنتم در این پالس نور متناظر است.

اتمهای خنثی

اتم خنثی از تعادل بارهای مثبت و منفی حاصل میشود. با استفاده از تکنولوژی لیزر میتوانیم این اتمها را با بردن به چندین حالت برانگیخته باردار کنیم. به این ترتیب هر کدام از این نوع اتمها میتوانند برای ایجاد کیوبیت بکار روند. قابلیت ویژه این نوع از کیوبیتها در مقایسه با سایر انواع کیوبیت در این است که این بیتهای کوانتومی در کاربردها و انجام عملیات محاسباتی در مقیاس بزرگ مفید هستند.

بهطور کلی، تکنولوژی کیوبیت اتمهای خنثی با تکنولوژی کیوبیت یونهای به دام افتاده مشابه است. تنها تفاوت در این است که در مورد اتمهای خنثی از نور به جای نیروهای الکترومغناطیسی جهت به دام انداختن کیوبیتها و نگه داشتن آنها در یک مکان خاص استفاده میشود. اتمها در این نوع کیوبیت باردار نیستند و مدارهایی که در این تکنولوژی معرفی میشوند، میتوانند در دمای اتاق عملیات منطقی را اجرا کنند.

محاسبات کوانتومی چیست؟

محاسبات کوانتومی یک مبحث بینرشتهای محسوب میشود که با بهرهگیری از مفاهیم مکانیک کوانتومی، علوم کامپیوتر و نظریه اطلاعات کوانتومی به حل مسائلی ورای توانایی قویترین کامپیوترهای کلاسیکی میپردازد. با وجود اینکه مطالعات در این زمینه ادامه دارد، اما در آیندهای نزدیک تکنولوژی کوانتومی قادر به حل پیچیدهترین مسائلی خواهد بود که حتی ابرکامپیوترها نیز یا نمیتوانند آنها را حل کنند و یا با سرعت بسیار بسیار کمتری قادر به حل آنها هستند. برای مثال، پردازش چالشهایی که برای یک کامپیوتر معمولی ممکن است هزاران سال طول بکشد، با استفاده از کامپیوتر کوانتومی فقط به چند دقیقه زمان نیاز دارد.

بیش از چهل سال پیش، مقالهای توسط «ریچارد فاینمن» (Richard Feynman) با عنوان «شبیهسازی فیزیک با کامپیوترها» منتشر شد که پایه و اساس آن چیزی است که امروز به عنوان محاسبات کوانتومی میشناسیم. قدرت بالای محاسبات کوانتومی و فرصتهایی که به علت پتانسیل بالای این نوع محاسبات در زمینه روشهای جدید رمزگذاری اطلاعات توسعه پیدا کرد، در زمینه نگهداری و رمزگذاری اطلاعات حساس بسیار حائز اهمیت است. به همین دلیل نیاز است روی روشهای رمزگذاری کوانتومی ایمن کار شود.

اگر بخواهیم بهطور خلاصه تفاوت محاسبات کلاسیکی و کوانتومی را توضیح دهیم باید به این نکته اشاره کنیم که در محاسبات کلاسیکی تعداد حالتهای ممکن بهصورت خطی افزایش مییابد. اما در محاسبات کوانتومی با توجه به اصل برهمنهی، تعداد حالات ممکن بهصورت تصاعدی با افزایش تعداد کیوبیتها زیاد میشود. چنین رشدی باعث میشود تعداد حالتهای ممکنی که توسط یک کامپیوتر کوانتومی در حال بررسی و پردازش است در مقایسه با یک کامپیوتر کلاسیکی بهطور قابل ملاحظهای افزایش پیدا کند. مطالعه مطلب زیر از مجله فرادرس به شما کمک میکند تا در زمینه الگوریتمهای کوانتومی و کاربردشان در محاسبات کوانتومی اطلاعات خود را کاملتر کنید.

الگوریتم شور و گراور

حوزه مطالعاتی محاسبات کوانتومی شامل مباحثی مانند سختافزارها و الگوریتمهای کوانتومی است. الگوریتمهای کوانتومی براساس ذخیرهسازی و دستکاری اطلاعات کار میکنند، بهگونهای که این اطلاعات قابل دسترسی برای کامپیوترهای کلاسیکی نباشد. همچنین یکی از مهمترین کاربردهای این الگوریتمها در حوزه «امنیت دیجیتال» است. الگوریتمهایی مانند «الگوریتم شور» (Shor’s Algorithm)، «الگوریتم گراور» (Grover’s Algorithm) و «الگوریتمهای رمزگذاری ایمن کوانتومی» (Quantum-Safe Encryption Algorithms) در همین زمینه توسعه یافتند.

الگوریتم شور که در سال ۱۹۹۴ توسط «پیتر شور» (Peter Shor) در آزمایشگاه «بل» (Bell) واقع در شرکت مخابراتی AT&T کشف شد، خطری بزرگ برای امنیت جهانی اینترنت و سیستمهای رمزنگاری معمولی است. این الگوریتم عمل شکستن یک عدد بسیار بزرگ را به عاملهای اول در مدت زمان کوتاهی انجام میدهد. البته در حال حاضر بعید است که هکرها و سارقان به کامپیوتر کوانتومی دسترسی داشته باشند. همچنین از نگاه مثبت، این امر به توسعه بخشهای جدید از محاسبات کوانتومی منجر شد و دانشمندان را وادار به توسعه رمزنگاری کوانتومی و مخابرات کوانتومی کرد. همچنین الگوریتم گراور برای جستوجو در پایگاههای داده خیلی بزرگ کاربرد دارد. انجام اموری که توسط الگوریتمهای شور و گراور در زمانی کوتاه صورت میگیرد، توسط قویترین ابرکامپیوترهای موجود ممکن است که تا ماهها و یا سالها طول بکشد.

اجزای یک کامپیوتر کوانتومی چیست؟

کامپیوتر کوانتومی نیز مانند کامپیوتر کلاسیکی از دو بخش سختافزار و نرمافزار تشکیل میشود. در ادامه توضیح میدهیم که منظور ما از بخش سختافزاری و نرمافزاری یک کامپیوتر کوانتومی چیست.

سختافزار کامپیوتر کوانتومی

بخش سختافزاری یک کامپیوتر کوانتومی شامل سه قسمت زیر است:

- صفحه داده کوانتومی

- صفحه اندازهگیری و کنترل

- صفحه پردازشگر کوانتومی و پردازشگر میزبان

صفحه داده کوانتومی

صفحه داده کوانتومی یا Quantum Data Plane در حقیقت هسته کامپیوتر کوانتومی محسوب میشود. این بخش شامل کیوبیتهای فیزیکی و ساختارهایی است که برای نگهداری این کیوبیتها در مکان مشخص موردنیاز است.

صفحه اندازهگیری و کنترل

این صفحه سیگنالهای دیجیتال را به سیگنالهای آنالوگ یا به سیگنالهای کنترلی موجی شکل تبدیل میکند. این سیگنالهای تولید شده به شکل آنالوگ، عملیات مختلفی را روی کیوبیتها در صفحه داده کوانتومی انجام میدهند.

صفحه پردازشگر کوانتومی و پردازشگر میزبان

در نهایت میخواهیم ببینیم آخرین جزء سختافزاری در یک کامپیوتر کوانتومی چیست و چه کاری انجام میدهد. صفحه پردازشگر کوانتومی الگوریتمهای کوانتومی یا ترتیب در عملیات را اجرا میکند. همچنین پردازشگری به نام پردازشگر میزبان یا Host Processor داریم که با بخش نرمافزاری کامپیوتر کوانتومی برهمکنش دارد و نتیجه آن، ارائه یک سیگنال دیجیتالی یا توالی بیتهای کلاسیکی برای صفحه اندازهگیری و کنترل است.

نرمافزار کامپیوتر کوانتومی

تا اینجا یاد گرفتیم سه رکن اصلی سختافزاری یک کامپیوتر کوانتومی چیست. بخش نرمافزاری کامپیوتر کوانتومی الگوریتمهای کوانتومی منحصر به فردی را با استفاده از مدارهای کوانتومی پیادهسازی میکند. مدار کوانتومی یک روال محاسباتی محسوب میشود که یک سری عملیات کوانتومی منطقی را روی کیوبیتها تعریف میکند. توسعهدهندگان این بخش میتوانند به کمک ابزارهای توسعه نرمافزاری مختلف در کنار کتابخانهها، این الگوریتمهای کوانتومی را طراحی کنند.

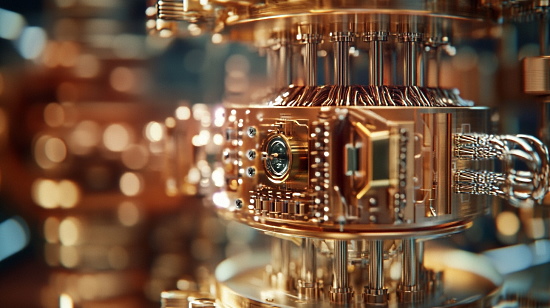

معروفترین کامپیوترهای کوانتومی ساخته شده

در بخشهای قبل یاد گرفتیم یک کامپیوتر کوانتومی چیست، مبنای محاسبات آن چگونه است و از چه اجزا و ساختارهایی تشکیل شده است. همزمان با توسعه تراشههای سیلیکونی و تکنولوژی ابررسانا، پیشبینی میشود که بهزودی به محدودیت قدرت محاسبه کامپیوترهای کلاسیکی نزدیک شویم و راهحل عبور از این محدویت، جایگزین کردن کامپیوترهای کوانتومی است.

در نتیجه موسسات و شرکتهای معروفی مانند «شرکت بینالمللی ماشینهای تجاری» (International Business Machines Corporation) یا IBM، «مایکروسافت» (Microsoft)، «گوگل» (Google) و «آمازون» (Amazon) به سرمایهگذاری در این زمینه پرداختهاند. پیشبینی این است که تا سال ۲۰۳۵ محاسبات کوانتومی به یک فناوری ۱٫۳ تریلیون دلاری تبدیل شود. معروفترین کمپانیهای دنیا در زمینه محاسبات کوانتومی، تولید و طراحی کامپیوتر کوانتومی طبق آخرین آمار سال ۲۰۲۴ بهترتیب عبارتاند از:

- کامپیوتر کوانتومی IBM

- کامپیوتر کوانتومی Intel

- کامپیوتر کوانتومی Google AI

- کامپیوتر کوانتومی Microsoft

- کامپیوتر کوانتومی Amazon Web Services

یادگیری علوم کامپیوتر و فیزیک کوانتوم با فرادرس

در انتهای این مطلب از مجله فرادرس، احتمالا متوجه شدهاید که دو وزنه مهم جهت درک بهتر مفاهیم محاسبات کوانتومی و در نتیجه، نحوه عملکرد یک کامپیوتر کوانتومی چیست. در این قسمت قصد داریم در همین راستا چند دوره آموزشی از مجموعه فرادرس را به شما معرفی کنیم. اگر دانشجوی گرایشهای مختلف علوم یا مهندسی کامپیوتر هستید و نیاز دارید با مبانی فیزیک کوانتوم آشنا شوید، مشاهده فیلمهای زیر را به شما پیشنهاد میکنیم:

- فیلم آموزش مکانیک کوانتومی – مرور و حل تست فرادرس

- فیلم آموزش مکانیک کوانتومی ۱ فرادرس

- فیلم آموزش مکانیک کوانتومی پیشرفته ۱ فرادرس

- فیلم آموزش رایگان مکانیک موجی در یک بعد در مکانیک کوانتومی ۱ فرادرس

- فیلم آموزش رایگان آموزش مکانیک موجی در سه بعد در مکانیک کوانتومی ۱ فرادرس

- فیلم آموزش رایگان مکانیک کلاسیکی در مکانیک کوانتومی ۱ فرادرس

اما در صورتی که به مباحث کوانتومی کاملا مسلط هستید، اما لازم است مبانی علوم کامپیوتر و نحوه عملکرد مدارهای منطقی را فرا بگیرید، تماشای دورههای آموزشی زیر از مجموعه فرادرس برای شما مناسب است:

- فیلم آموزش مبانی الکترونیک دیجیتال فرادرس

- فیلم آموزش مدارهای منطقی یا سیستم های دیجیتال ۱ فرادرس

- فیلم آموزش رایگان الگوریتم ها و روش های جست و جو در آرایه فرادرس

- فیلم آموزش فلیپ فلاپ تی T – مدار منطقی ترتیبی سنکرون فرادرس

کاربرد کامپیوتر کوانتومی چیست؟

کاربرد محاسبات کوانتومی در حوزههای مختلفی شامل موارد زیر، میتواند منجر به تحول عظیمی در پیشرفت صنایع مختلف شود:

- یادگیری ماشین

- بهینهسازی

- شبیهسازی

- رمزنگاری

- اقتصاد و ارزهای دیجیتال

برای مثال، «یادگیری ماشین» (Machine Learning) یا ML فرآیند تحلیل مقادیر گستردهای از داده است تا به کامپیوترها جهت ارائه پیشبینی یا تصمیمگیریهای درستتر کمک شود. پژوهشها در حوزه محاسبات کوانتومی در حال بررسی محدودیتهای فیزیکی پردازش دادهاند تا از این طریق به توسعه یادگیری ماشین کمک کنند.

جمعبندی

در انتها اگر بخواهیم به این سوال پاسخ دهیم که آیا کامپیوترهای کوانتومی قرار است جایگزین کامپیوترهای معمولی شوند، شاید بتوان با قطعیت به این سوال پاسخ خیر داد. میتوانیم کاربرد کامپیوتر کوانتومی در مقایسه با کامپیوتر معمولی را به کاربرد لیزر در مقایسه با نور تشبیه کنیم. لیزر جایگزین نور نشد، اما کاربردهای خاص و مهم خود را ارائه میدهد. از آنجایی که شرایط نگهداری و تعریف کیوبیتها شرایط خاصی مانند خلاء بالا و یا دمای خیلی پایین است، بنابراین دور از انتظار است که در آینده، تلفن همراه و یا کامپیوتر خانگی ما حاوی تراشهای کوانتومی باشد. اما بیشک، کامپیوتر کوانتومی نوع خاصی از کامپیوتر است که برای انجام و اجرای الگوریتمهایی خاص و پیچیده توسعه پیدا کرده است.

از طریق چه رشته هایی میتوان وارد این حوزه شد ؟

زمانی که سیستم عامل داس ساخته شده حداکثر حافظه ای که توان مدیریت اون رو داشته فکر میکنم ۱۶ مگابایت بوده یعنی سازنده اون با خودش فکر میکرده امکان نداره برنامه ای ساخته بشه که از ۱۶ مگ بیشتر نیاز داشته باشه.من خودم زمان دبیرستان با سیستم عامل داس کار میکردم.بعدش کم کم شاهد کامپیوترها و سی پی یو ها و سیستم عامل های قوی تر شدیم.یادمه یک زمانی یک استادی داشتیم میگفت دیگه قدرت سی پی یو ها به آخرش رسیده و از این بیشتر نمیشه.اما حالا باید شاهد پردازنده های کوانتومی باشیم.بسیار هم عالی.نمیشه از الان گفت در اینده این پردازنده ها جایگزین پردازنده های معمولی رو نگیره و یا حتی تکنولوژی بالاتر از این نیاد.انسان ذاتا کنجکاو آفریده شده و روز به روز حقایق این زمین خاکی رو بیشتر کشف میکنه.تا قرن ۲۱ درک و فهم انسان به این حد رسیده.واقعا آدمهای قرون آینده به چه درک و فهمی نسبت به این زمین خاکی خواهند رسید.خیلی جالبه.ما اون زمان کجا هستیم.

نظر من در مورد کوانتوم یا کامپیوترهای کوانتومی نیست ولی سالهاست در مورد این موضوعی که عنوان میکنم فکر کردم ، هر انسانی امواج صوتی صدایش با انسانی دیگر تفاوت دارد در آینده میتوان بدون تلفن همراه و از طریق فرستنده و گیرنده امواج صوتی را رد وبدل کرد به نظر شما امکان دارد

دوستان این نکته رو در نظر داشته باشید که لازم نیست این کامپیوتر ها در خانه افراد باشند . فقط کافیه شما یه گیرنده و نمایشگر داشته باشید و از نرم افزار ها و بازی ها بصورت ابری و برخط استفاده کنید و یعنی کیس داخل شرکت هست و بازی یا نرم افزار روش اجرا میشه و شما خروجی رو دریافت میکنید .واقعا منتظر اون روز هستم .چقدر رندر سه یعدی راحت میشه خدا میدونه .عالیه

وقتی میگن علم یعنی قدرت یعنی همین. دیگه هیچ رمزی روی سیستمی معنی نمیده. مسلما نسل جدید نرم افزارهای طراحی شده توسط کوانتوم خیلی متفاوت تر از نرم افزارهای امروزیست. کوانتوم فلسفه ی زندگی و حتی کل زندگی بشر رو تغییر میده.

کامپیوتر ساخته شده توسط Dwave کوانتومیه؟

پس چرا اغلب شرکت ها می گن تا ساخت کامپیوتر کوانتومی هنوز فاصله داریم؟

من فکر نکنم اینا رو به مردم عادی بفرشن. چرا؟ چون اگه دست یه ادم دیوونه بیفته میتون در عرض چند دقیقه کل سیستم موشک های اتمی دنیا رو هک کنه و همرو به کشتن بده حتی خودش رو

چرا این مقاله تاریخ نداره؟!

باسلام. اول اینکه اقای دکتر هم دانشگاهی و هم رشته ای بنده هستند. خوشبختم جناب دکتر.

مطلب بسیار جامع و خوب نوشته شده. میخواستم 1 موضوعی رو اضافه کنم. میشه اینجوری هم عنوان کرد که یکی از دلایل اصلی این موج اشتیاق به سمت پردازنده های کوانتومی دغدغه هوش مصنوعی و پیاده سازی شبکه های عصبی به صورت سخت افزاری هست.نرون های عصبی، سیناپس ها و دندریت ها در حال حاضر به شکل شدیدی معلول به عملکرد و سرعت ترانزیستورهای cmosهستند و برای همین که بحث یادگیری عمیق به شکل محسوسی ناکارآمد هست. تولد مدارهای کوانتومی در اینده ای نزدیک با مدل های Neuromorphic ادغام خواهند شد و احتمالا ما به مغزافزار عصبگون با حالت فازی الکترودینامیک طبیعی نزدیک خواهیم شد که احتمالا جهشی بزرگ در دنیای هوش مصنوعی خواهد بود.

به همین دلیل هست که کمپانی های که در زمینه AI پیشگام هستند به صورت موازی روی بحث رایانش کوانتمی هم تمرکز کردند مثل IBM, Google, ماکروسافت و اینتل.

سلام، وقت شما بخیر؛

تاریخ آخرین به روز رسانی کلیه مقالات مجله فرادرس در زیر عنوان آنها ذکر شده است.

از همراهی شما سپاسگزاریم.

چطوری میشه ساخت اینو

ابزار و وسایلش زیر مقاله ذکر شده یه نگاه بندازی دستت میاد

جدای از شوخی ساخت این سیستم ها به قدری پیچیده هست که وقتی یه شرکتی فقط چند کیوبیت به کامپیوترش اضافه میکنه برتری کوانتمی محسوب میشه

در کل علوم خیلی زیادی دست به دست هم دادن

بسیار عالی و کاربردی بود

خیلی جذاب بود

نوشته هم بسیار ساده و شیوا بود

خدا خیرتون بده

ممنون خيلي خوب بود. يک سوال داشتم. تکنولوژي ساخت کامپيوترهاي کوانتومي چيست؟ ترانزيستور؟

بنده خدا دوساعت داشت میگفت اینا فرق دارن با گیت های معمولی بعد میگی ترانزیستور ?

ممنون خیلی خوب بود

بهترین مقاله ای بود که تا الان خوندم عالی بود عالی

سپاس