روش رانگ کوتای مرتبه دوم – از صفر تا صد

در آموزشهای پیشین مجله فرادرس، با روش رانگ کوتای مرتبه اول و مرتبه چهارم آشنا شدیم. در این آموزش، روش رانگ کوتای مرتبه دوم (Second Order Runge-Kutta) را برای حل معادلات دیفرانسیل معرفی خواهیم کرد.

تعریف مسئله

معادله دیفرانسیل زیر با جواب را در نظر بگیرید:

میخواهیم جواب را با کامپیوتر تقریب بزنیم (با دانستن شرایط اولیه ). در ادامه، یک روش شهودی برای انجام این کار ارائه کرده و مثالهایی را نیز بررسی میکنیم. این روش همان روش رانگ کوتای مرتبه دوم است.

روش رانگ کوتای مرتبه دوم

در این بخش، روش رانگ کوتای مرتبه دوم را برای دستههایی از معادلات دیفرانسیل به صورت شهودی معرفی خواهیم کرد.

معادله دیفرانسیل مرتبه اول بدون ورودی

همانطور که در آموزشهای پیشین گفتیم، در روش رانگ کوتای مرتبه اول، از مشتق در زمان (در شکل زیر ) برای تخمین مقدار تابع در یک گام زمانی بعد استفاده میشود. برای مثال، معادله دیفرانسیل زیر را در نظر بگیرید:

یا

که شرایط اولیه آن است. جواب دقیق این معادله برای است که فرض میکنیم آن را نمیدانیم و برای ارائه یک تقریب به انتگرالگیری عددی نیاز داریم.

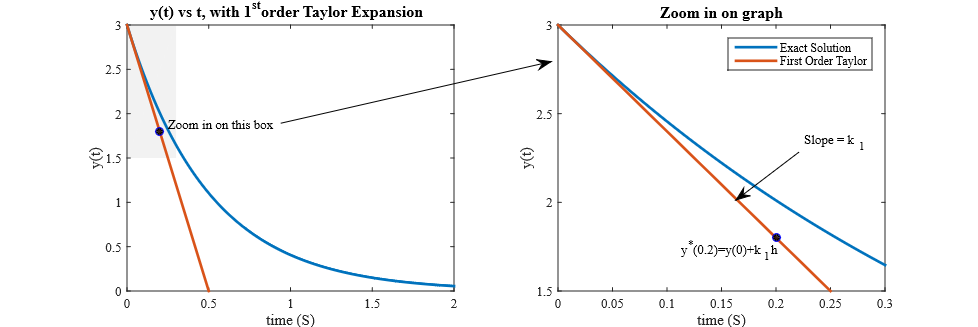

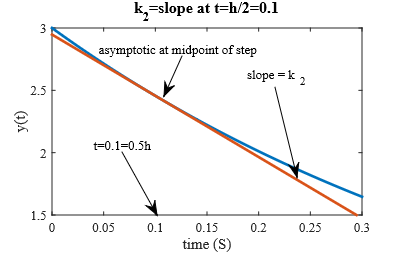

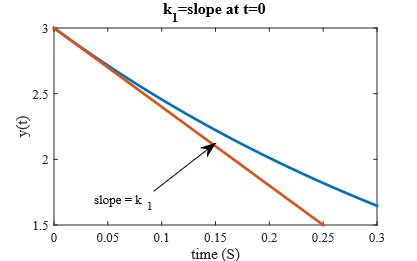

در شکل زیر، شیب در را و تخمین را مینامیم که در این مثال، است.

بدیهی است که مقداری خطای تخمین وجود دارد که میخواهیم آن را کم کنیم. یکی از راههای نیل به این هدف، استفاده از مشتق در نقطه میانی بین و است. شیب در این نقطه () در شکل زیر نشان داده شده و با مشخص شده است. خط نارنجی نیز، در واقع خط مماس بر منحنی آبی در است.

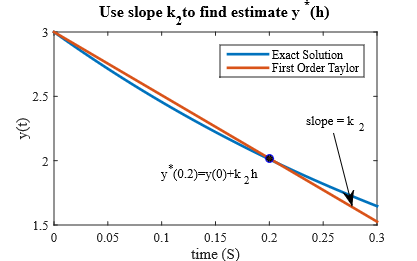

اکنون اگر از شیب میانی استفاده کنیم، تخمین بهتری نسبت به قبل برای خواهیم داشت. در شکل زیر، مقدار دقیق جواب و همچنین، تقریب برای خطایی در حدود درصد نشان داده شدهاند. دقت کنید که در روش رانگ کوتای مرتبه اول، این خطا تقریباً درصد است.

به نظر میرسد جواب تقریب بسیار مناسبی دارد و بدیهی است که دقت آن نسبت به جواب به دست آمده از روش رانگ کوتای مرتبه اول (که در آن از خطی با شیب در استفاده میشد) بسیار بیشتر است. مسئلهای که با آن مواجهیم، این است که مقدار دقیق را نمیدانیم و به همین دلیل نمیتوانیم مقدار دقیق را بیابیم. لازم به یادآوری است که محاسبه مشتق نیازمند دانستن مقدار تابع است ().

یک راه برای حل این مشکل، استفاده از روش اویلر یا همان روش رانگ کوتای مرتبه اول برای به دست آوردن تقریب در است که آن را مینامیم. سپس میتوانیم از این تخمین برای به دست آوردن (که تقریبی از شیب در نقطه میانی است) استفاده کنیم و در نتیجه، از برای یافتن بهره ببریم. برای رفتن از نقطه شروع در تا تخمین در ، فرایند زیر را انجام میدهیم:

عبارت مشتق در :

مشتق در :

تخمین میانی تابع در :

تخمین شیب در :

سری تیلور حول :

سری تیلور بریده:

تخمین :

در حالت کلی، یک گام به جلو از تخمین تا به صورت زیر انجام میشود:

عبارت مشتق در :

مشتق در :

تخمین میانی تابع در :

تخمین شیب در :

سری تیلور حول :

سری تیلور بریده:

تخمین :

تقریب معادله دیفرانسیل مرتبه اول بدون ورودی با استفاده از متلب

میتوانیم از متلب استفاده کنیم و محاسبات بالا را با استفاده از آن پیادهسازی کنیم. روندی که در بالا آن را توضیح دادیم، به صورت زیر در متلب پیاده میشود:

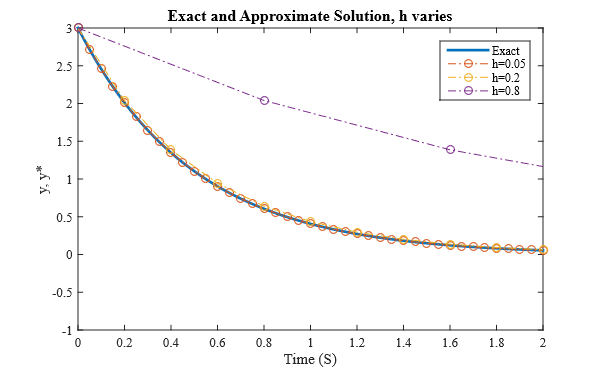

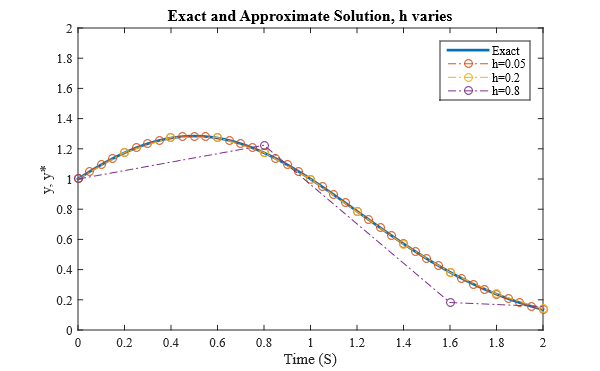

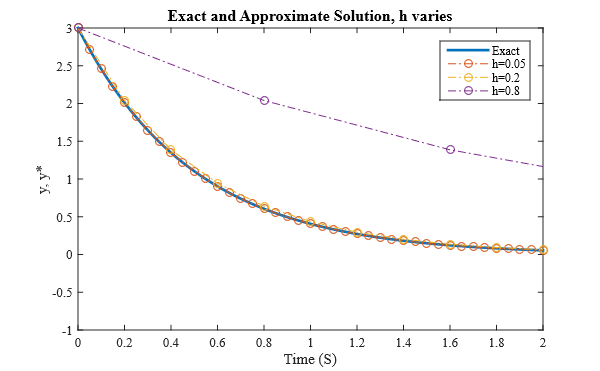

هر خط از کد بالا به خوبی مراحل الگوریتم را نشان میدهد. با تغییر اندکی در برنامه، میتوان اثر اندازه را بر دقت جواب مشاهده کرد. شکل زیر این موضوع را به خوبی نشان میدهد. همانطور که میبینیم، هرچه مقدار بزرگتر باشد، تقریب ضعیفتر خواهد بود.

الگوریتم روش رانگ کوتای مرتبه دوم (نقطه میانی)

معادله دیفرانسیل مرتبه اول زیر داده شده است:

برای حرکت رو به جلوی یک نقطه در ، یعنی ، به اندازه یک گام زمانی ، مراحل زیر را طی میکنیم:

تخمین مشتق در :

تخمین میانی تابع در :

تخمین شیب در :

تخمین :

دقت کنید که مقدار اولیه یا همان شرایط اولیه در ابتدای الگوریتم مشخص باشد.

از الگوریتم رانگ کوتای مرتبه دوم اغلب با نام الگوریتم نقطه میانی (Midpoint Algorithm) یاد میشود، زیرا از شیب در نقطه میانی استفاده میکند.

معادله دیفرانسیل مرتبه اول با ورودی

با اضافه شدن تابع ورودی به معادله دیفرانسیل، مشکل چندانی به وجود نخواهد آمد. فقط لازم است مقدار تابع در را برای یافتن و همچنین، مقدار آن را در برای یافتن تضمین کنیم. برای مثال، ورودی را در نظر بگیرید.

یا

بنابراین، مراحل زیر را طی میکنیم:

عبارت مشتق در :

تقریب مشتق در :

تخمین میانی تابع در :

تخمین شیب در :

تخمین :

گفتنی است که جواب دقیق این معادله است.

تقریب معادله دیفرانسیل مرتبه اول با ورودی با استفاده از متلب

میتوانیم از متلب برای محاسبات بالا استفاده کنیم. برای این تقریب جدید، باید محاسبات و را با استفاده از مقدار مناسب متغیر زمان تغییر دهیم. برنامه زیر در متلب مربوط به مثال اخیر است.

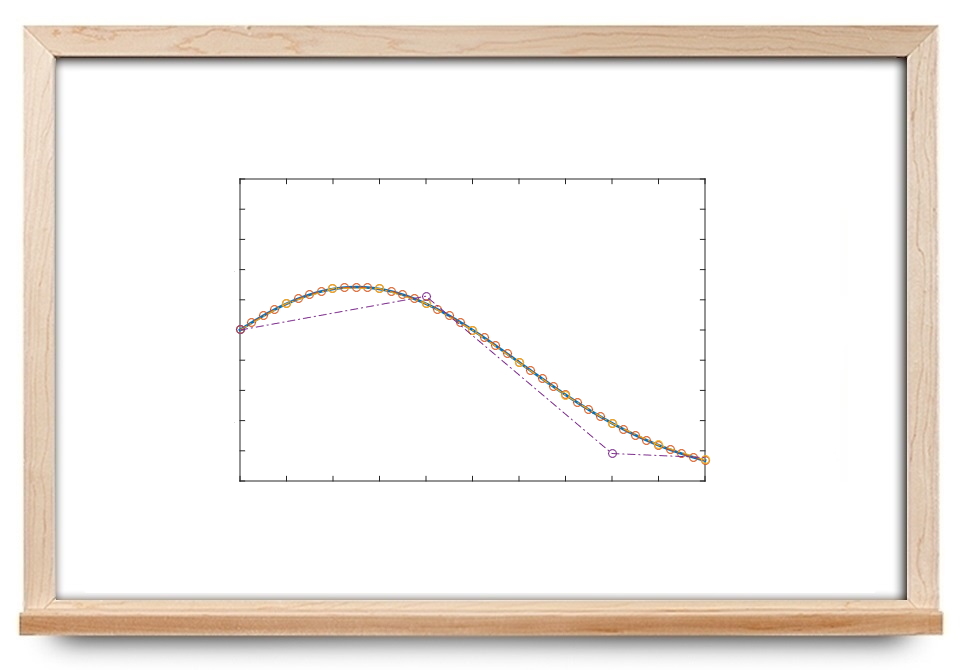

با کمی تغییر در برنامه بالا، میتوانیم تقریب را برای های مختلف رسم کنیم. همانطور که میبینیم، با کوچک شدن ، تقریبها دقیقتر خواهند بود.

معادله دیفرانسیل غیرخطی مرتبه اول

در این مورد نیز با مشکل خاصی مواجه نخواهیم بود. در اینجا نیز باید تضمین کنیم که مقدار تابع در را برای یافتن و همچنین، مقدار آن را در برای یافتن داریم. برای مثال، سیستم زیر را در نظر بگیرید:

میدانیم که جواب این معادله به صورت زیر است:

روند عددی به دست آوردن جواب معادله نیز مطابق مراحل زیر است:

عبارت مشتق در :

تقریب مشتق در :

تخمین میانی تابع در :

تخمین شیب در :

تخمین :

تقریب معادله دیفرانسیل غیرخطی مرتبه اول با ورودی با استفاده از متلب

مانند مثالهای قبل، به سادگی میتوانیم برنامه تقریب معادله دیفرانسیل غیرخطی مرتبه اول با ورودی را در متلب بنویسیم. این برنامه به صورت زیر است:

شکل زیر، جواب دقیق و تقریبی معادله را به ازای های مختلف نشان میدهد.

همانطور که مشاهده میکنیم، با کاهش ، دقت تقریب زیاد میشود.

معادله دیفرانسیل خطی مرتبه بالاتر

معادله دیفرانسیل مرتبه بالاتر زیر را در نظر بگیرید:

$$ \large \displaylines {<br /> { { { d ^ 3 } y ( t ) } \over { d t } } + 4 { { { d ^ 2 } y ( t ) } \over { d t } } + 6 { { d y ( t ) } \over { d t } } + 4 y ( t ) = \gamma ( t ) \quad \quad \quad \gamma ( t ) = { \rm{unit step function}} \cr<br /> { \left . { { { { d ^ 2 } y ( t ) } \over { d t } } } \right | _ { t = { 0 ^ + } } } = 0 , \quad \quad { \left. { { { d y ( t ) } \over { d t } } } \right | _ { t = { 0 ^ + } } } = - 1 , \quad \quad y ({ 0 ^ + } ) = 0 \quad \cr } $$

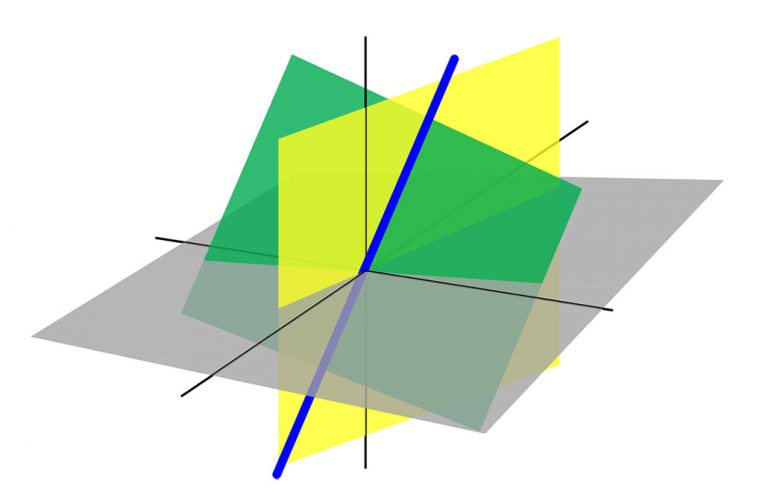

معادله بالا را میتوانیم به صورت دستگاه معادلات دیفرانسیل ماتریسی بازنویسی کنیم:

$$ \large \eqalign {<br /> { \bf { q } }' ( t ) & = \left[ { \matrix {<br /> { { q _ 1 }' ( t ) } \cr<br /> { { q _ 2 }' ( t ) } \cr<br /> { { q _ 3 }' ( t ) } \cr } } \right] = \left[ { \matrix {<br /> 0 & 1 & 0 \cr<br /> 0 & 0 & 1 \cr<br /> { - 4 } & { - 6 } & { - 4 } \cr } } \right] \left [ { \matrix {<br /> { { q _ 1 } ( t ) } \cr<br /> { { q _ 2 } ( t ) } \cr<br /> { { q _ 3 } ( t ) } \cr } } \right] + \left[ { \matrix {<br /> 0 \cr<br /> 0 \cr<br /> 1 \cr } } \right ] \gamma ( t ) \cr<br /> { \bf { q } }' (t ) & = { \bf { A q } } ( t ) + { \bf { B \gamma } } ( t ) \cr<br /> { \bf { A } } & = \left [ { \matrix {<br /> 0 & 1 & 0 \cr<br /> 0 & 0 & 1 \cr<br /> { - 4} & { - 6} & { - 4} \cr} } \right],\quad \quad \quad { \bf { B } } = \left [ {\matrix{<br /> 0 \cr<br /> 0 \cr<br /> 1 \cr<br /> } } \right] \cr} $$

روند به دست آوردن جواب در این حالت، به صورت زیر است:

عبارت مشتق در :

تقریب مشتق در :

تخمین میانی تابع در :

تخمین شیب در :

تخمین :

جواب دقیق معادله برای برابر با است.

تقریب معادله دیفرانسیل مرتبه سوم با استفاده از متلب

برای تقریب لازم است متغیرهای مناسب اسکالر را با بردار یا ماتریس تغییر دهیم و ماتریسهای و را تعریف کنیم. توجه کنید که در این حالت، ماتریس را در ضرب میکنیم، زیرا ورودی یک پله واحد است ( برای ). اگر ورودی یک شکل موج سینوسی بود، باید آن در در ضرب میکردیم. اگر ورودی وجود نداشته باشد، لازم نیست ماتریس را در نظر بگیریم. کد زیر مربوط مثال اخیر است.

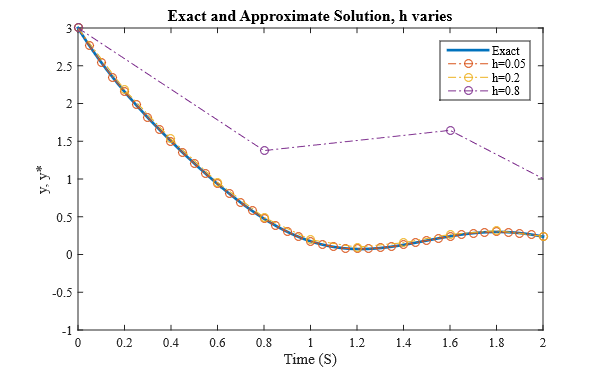

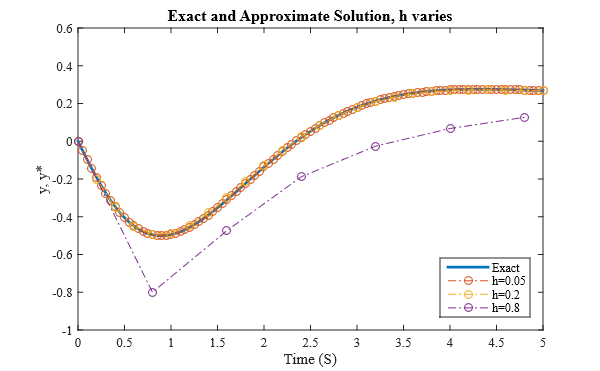

شکل زیر، جواب دقیق و تقریبی معادله را به ازای های مختلف نشان میدهد.

ریاضیات روش رانگ کوتای مرتبه دوم

الگوریتم رانگ کوتای مرتبه دوم به صورت موردی در بالا توضیح داده شد. دیدیم که با استفاده از تقریب مشتق در نقطه میانی بازه بین و ، یعنی در ، تقریب خوبی برای تابع در خواهیم داشت. این تقریب نسبت به حالتی که از مشتق در استفاده کنیم (همان روش اویلر یا رانگ کوتای مرتبه اول) بهتر است. اما آیا راهی برای به دست آوردن روش رانگ کوتای مرتبه دوم از قواعد پایه و اساسی وجود دارد؟ اگر چنین باشد، میتوانیم به تقریبهای بهتری برسیم. در ادامه، این موضوع را بررسی خواهیم کرد.

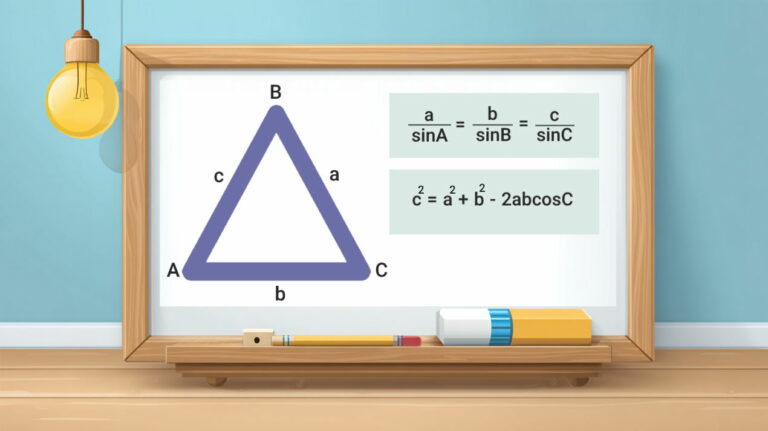

مرور برخی از ابزارهای ریاضی مفید

در این بخش، دو ابزار مهم ریاضی را معرفی میکنیم که از آنها استفاده خواهیم کرد.

(۱) اگر تابع دومتغیره را داشته باشیم، سری تیلور حول به صورت زیر خواهد بود:

$$ \large \eqalign {<br /> g ( { x _ 0 } + \Delta x , { y _ 0 } + \Delta y ) & = g ( { x _ 0 } , { y _ 0 } ) + { \left . { { { \partial g ( x , y ) } \over { \partial x } } } \right | _ { { x _ o } , { y _ 0 } } } \Delta x + { \left . { { { \partial g ( x , y ) } \over { \partial y } } } \right | _ { { x _ o } , { y _ 0 } } } \Delta y + \cdots \cr<br /> & = g + { g _ x } \Delta x + { g _ y } \Delta y + \cdots \cr } $$

که در آن، نمو بُعد اول و نمو بُعد دوم است. در خط آخر فرمول، از نمادگذاری خلاصه استفاده شده است. که در آن، نمایانگر مشتق جزئی نسبت به و نشان دهنده مشتق جزئی نسبت به است.

(۲) اگر تابعی از دو متغیر باشد () که در آن، و ، آنگاه با استفاده از قاعده زنجیرهای برای مشتق جزئی داریم:

در حالت خاص، اگر داشته باشیم:

آنگاه:

روش رانگ کوتای مرتبه دوم

برای شروع، باز هم یک معادله دیفرانسیل مرتبه اول را در نظر میگیریم:

اکنون دو تقریب را برای مشتق داریم:

$$ \large \eqalign {<br /> & { k _ 1 } = f (y ^ * ( { t _ 0 } ) , { t _ 0 } ) \cr<br /> & { k _ 2 } = f ( y ^ * ( { t _ 0 } ) + \beta h { k _ 1 } , { t _ 0 } + \alpha h ) \cr } $$

در همه حالات، و مقادیری کسری بین و هستند. این معادلات بیان میکنند که تقریب مشتق بر اساس تخمین مقدار در (یعنی ) و در زمان است. مقدار مبتنی بر مقدار تخمین زده شده به علاوه کسری از اندازه گام () ضرب در شیب و زمان در (یعنی زمانی بین و ) است. در روشی که در بالا معرفی کردیم، است، اما انتخابهای دیگری نیز میتوان در نظر گرفت.

برای بهروزرسانی جواب با تقریب بعدی در ، از معادله زیر استفاده میکنیم:

این معادله بیان میکند که مقدار از مقدار به علاوه گام زمانی ضرب در یک شیب به دست آمده که مجموع وزنداری از و است.

در روشی که در بالا بیان کردیم، و است. بنابراین، فقط از تخمین دوم برای شیب استفاده کردیم. لازم به ذکر است که روش اویلر (رانگ کوتای مرتبه اول) حالت خاصی از این روش با و است و مهم نیست و چه مقداری داشته باشند، زیرا در معادله بهروزرسانی مورد استفاده قرار نمیگیرد.

اکنون هدفمان این است که با استفاده از آن قاعده اول ریاضی که بیان کردیم، تعیین کنیم که چگونه میتوان ، ، و را به گونهای یافت که خطا کم شود. از معادله بهروزرسانی بالا شروع میکنیم و میتوانیم عبارات داده شده قبلی را برای و جایگذاری کنیم که منجر به رابطه زیر میشود:

میتوانیم از سری تیلور دوبعدی استفاده کنیم (که نمو بعد اول و نمو بعد دوم است):

$$ \large \eqalign {<br /> f \left ( { { y ^ * } ( { t _ 0 } ) + \beta h { k _ 1 } , \, { t _ 0 } + \alpha h } \right ) & = f + { f _ y } \beta h { k _ 1 } + { f _ t } \alpha h + \cdots \cr<br /> & = f + { f _ y } f \beta h + { f _ t } \alpha h + \cdots \cr } $$

در خط آخر، از این واقعیت استفاده کردهایم که . جملات مرتبه دوم و بالاتر نوشته نشدهاند. با قرار دادن رابطه اخیر در عبارت قبلی برای و بازآرایی آن، خواهیم داشت:

$$ \large \eqalign {<br /> { y ^ * } ( { t _ 0 } + h ) & = { y ^ * } ( { t _ 0 } ) + h \left ( { a f + b \left ( { f + { f _ y } f \beta h + { f _ t } \alpha h + \cdots } \right ) } \right ) \cr<br /> & = { y ^ * } ( { t _ 0 } ) + h a f + h b f + { h ^ 2 } b \beta { f _ y } f + { h ^ 2 } { f _ t } b \alpha + \cdots \cr<br /> & = { y ^ * } ( { t _ 0 } ) + h ( a + b ) f + { h ^ 2 }{ f _ t } b \alpha + { h ^ 2 } b \beta { f _ y } f + \cdots \cr } $$

با استفاده از مشتقات جزئی، میتوان نوشت:

$$ \large \eqalign {<br /> y ( { t _ 0 } + h ) & = y ( { t _ 0 } ) + h { \left . { y' ( t ) } \right | _ { { t _ 0 } } } + { { { h ^ 2 } } \over 2 } { \left . { y ^ {\prime \prime } ( t ) } \right | _ { { t _ 0 } } } + \cdots \cr<br /> & = y ( { t _ 0 } ) + h f + { { { h ^ 2 } } \over 2 } \left ( { { f _ t } + { f _ y } f } \right ) + \cdots \cr<br /> & = y ( { t _ 0 } ) + h f + { { { h ^ 2 } } \over 2 } { f _ t } + { { { h ^ 2 } } \over 2 } { f _ y } f + \cdots \cr } $$

با مقایسه این عبارت با عبارت نهایی تقریبِ

ثابتهای ، ، و به صورت زیر هستند:

$$ \large \displaylines {<br /> a + b = 1 \cr<br /> b \alpha = { 1 \over 2 } \cr<br /> b \beta = { 1 \over 2 } \cr } $$

در این دستگاه چهار مجهول و فقط سه معادله وجود دارد؛ بنابراین، بیش از یک جواب خواهیم داشت. واضح است که و و یکی از جوابها است. از آنجا که همه جملات تقریب برابر با جملات در جواب دقیق هستند، خطای محلی این روش است. خطای سراسری نیز است و به همین دلیل به این روش رانگ کواتای مرتبه دوم میگویند.

فرم دیگر روش رانگ کوتای مرتبه دوم

یک انتخاب دیگر برای ضرایب الگوریتم و است. با معادلات ، و شروع میکنیم:

$$ \large \eqalign {<br /> { k _ 1 } & = f ( { y ^ * } ( { t _ 0 } ) , { t _ 0 } ) \cr<br /> { k _2 } & = f ( { y ^ * } ( { t _ 0 } ) + \beta h { k _ 1 } , { t _ 0 } + \alpha h ) \cr<br /> { y ^ * } ( { t _ 0 } + h ) & = { y ^ * } ( { t _ 0 } ) + h ( a { k _ 1 } + b { k _ 2 } ) \cr } $$

با توجه به ضرایبی که گفتیم، داریم:

$$ \large \eqalign {<br /> { k _ 1 } & = f ( { y ^ * } ( { t _ 0 } ) ,{ t _ 0 } ) \cr<br /> { k _ 2 } & = f ( { y ^ * } ( { t _ 0 } ) + h { k _ 1 } , { t _ 0 } + \alpha h ) \cr<br /> { y ^ * } ( { t _ 0 } + h ) & = { y ^ * } ( { t _ 0 } ) + h \left ( { { { { k _ 1 } + { k _ 2 } } \over 2 } } \right ) \cr } $$

بنابرراین، الگوریتم را در این حالت میتوان به صورت زیر نوشت:

تخمین مشتق در :

تخمین میانی تابع در :

تخمین شیب در :

تخمین با استفاده از میانگین شیبها:

برای مثال، باز هم معادله دیفراسیل زیر را در نظر میگیریم:

یا

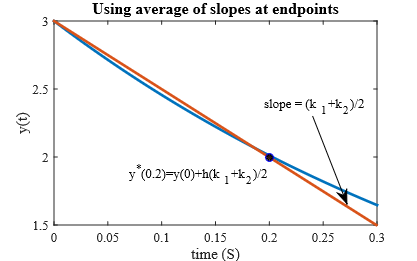

که شرایط اولیه آن بوده و میدانیم جواب دقیق آن است. آنچه که میخواهیم انجام دهیم، یافتن مشتق در ابتدای گام زمانی ( در گام اول) و در پایان گام زمانی است. شیب در نقطه شروع را مینامیم که مقدار عددی آن است. شیب در این نقطه در شکل زیر نشان داده شده است. در این شکل، خط (نارنجی) مماس بر منحنی (آبی) در مشخص است.

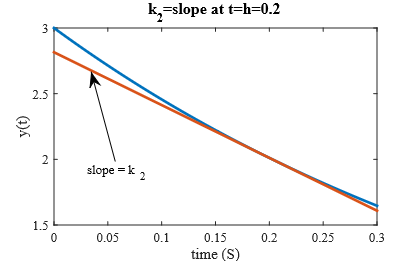

شیب در نقطه انتهایی در شکل زیر نشان داده شده که مقدار عددی آن است.

حال میانگین دو شیب () را در نظر گرفته و با استفاده از آن به جلو حرکت میکنیم.

این جواب به جواب دقیق بسیاز نزدیک بوده و خطای آن تقریباً درصد است. همچنین، این مقدار نزدیک به روش نقطه میانی و بسیار بهتر از روش مرتبه اول است.

الگوریتم روش رانگ کوتای مرتبه دوم (نقطه انتهایی)

معادله دیفرانسیل مرتبه اول زیر داده شده است:

برای حرکت از یک نقطه در به اندازه یک گام زمانی، مراحل زیر را طی میکنیم:

تقریب مشتق در :

تقریب مقدار نقطه انتهایی در :

تقریب شیب در نقطه انتهایی :

تقریب با استفاده از شیب میانگین:

تقریب معادله دیفرانسیل مرتبه سوم با استفاده از متلب

در اینجا، مثال معادله دیفرانسیل مرتبه اول بدون ورودی را برای روش نقطه انتهایی در متلب پیادهسازی میکنیم. در آن مثال از روش نقطه میانی استفاده کردیم. کد متلب مربوط به روش نقطه انتهایی به صورت زیر است:

با اندکی تغییر در برنامه بالا، اثر اندازه گام بر دقت تقریب قابل بررسی است. شکل زیر نشان میدهد که برای های بزرگتر، دقت کاهش پیدا میکند. این نتیجه را برای روش نقطه میانی نیز به دست آوردیم.

اگر این مطلب برایتان مفید بوده است، آموزشهای زیر نیز به شما پیشنهاد میشوند:

- مجموعه آموزشهای محاسبات عددی

- آموزش محاسبات عددی (مرور و حل مساله)

- مجموعه آموزشهای دروس ریاضیات

- آموزش محاسبات عددی با MATLAB

- درون یابی اسپلاین — از صفر تا صد

- درون یابی هرمیت — از صفر تا صد

- درون یابی خطی — به زبان ساده

^^