همگرایی دنباله متغیرهای تصادفی – آشنایی با انواع آن

اگر با دنبالهای از متغیرهای تصادفی سروکار داشته باشیم، همگرایی آنها به یک نقطه یا مقدار خاص اهمیت پیدا میکند در غیر این صورت نمیتوانیم برایش رفتار مشخصی برای مقادیر بعدی یا مثلا در آینده تصور کنیم. به همین جهت، همگرایی دنباله متغیرهای تصادفی و انواع آن، موضوع این نوشتار مجله فرادرس قرار گرفته است.

برای آشنایی بیشتر با متغیر تصادفی و ویژگیهای آن بهتر است مطلب متغیر تصادفی، تابع احتمال و تابع توزیع احتمال و توزیع تجمعی — به زبان ساده را مطالعه کنید. همچنین خواندن نوشتارهای توزیعهای آماری — مجموعه مقالات جامع وبلاگ فرادرس و قضیه حد مرکزی و تعمیم آن — به زبان ساده برای درک بهتر اصطلاحات مربوط به همگرایی دنباله متغیرهای تصادفی نیز خالی از لطف نیست.

همگرایی دنباله متغیرهای تصادفی

در «نظریه احتمال» (Probability Theory)، نمادها و اشکال مختلفی برای همگرایی دنباله متغیرهای تصادفی وجود دارد که در ادامه با آنها آشنا خواهیم شد. البته توجه دارید که در اینجا منظور از همگرایی دنباله متغیرهای تصادفی تمایل آنها در نهایت به سمت یک متغیر تصادفی دیگر است که رفتار یا توزیع مشخصی دارد و البته این احتمال نیز هست که این دنباله به یک «متغیر تصادفی تباهیده» (Identical Random Variable) میل کند که در حقیقت آن را مقدار ثابت در نظر میگیریم.

کاربردهای زیادی از همگرایی دنباله متغیرهای تصادفی وجود دارد از جمله میتوان به بحث فرآیندهای تصادفی و رفتار نهایی آنها اشاره کرد که موضوع مهمی در نظریه احتمال بخصوص نظریه بازیها محسوب میشود. به این ترتیب برای شناخت موقعیت یک فرآیند تصادفی در نهایت، باید موفق به شناخت رفتار متغیری شویم که دنباله به آن همگرا است. همگرایی دنباله متغیرهای تصادفی بخصوص در بحث مربوط به مارتینگلها (Martingales) نیز مورد تجزیه و تحلیل قرار میگیرد.

همانطور که اشاره شد، ممکن است وضعیت همگرایی دنباله متغیرهای تصادفی در یک مقدار یا نقطه خلاصه شده یا به یک متغیر تصادفی دیگر همگرا شود. به این ترتیب اگر تابع توزیع احتمال متغیری که دنباله به آن همگرا است را بدانیم، میتوانیم رفتار دنباله را در آینده پیشبینی کنیم. در هر حالت نحوه نمایش و شیوه همگرایی دنباله متغیرهای تصادفی برایمان مهم است.

نکته: اگر دنباله متغیرهای تصادفی، به مقدار یا متغیر تصادفی دیگری همگرا نباشند، رفتار آن در آینده قابل پیشبینی نخواهد بود. در این حالت دنباله را «واگرا» (Divergence) میگویند.

مقدمهای بر همگرایی دنباله متغیرهای تصادفی

در «همگرایی تصادفی» (Stochastic Convergence)، ایده مربوط به تمایل دنبالهای از متغیرهای تصادفی یا در حقیقت دنبالهای از پیشامدهای تصادفی، فرمولبندی شده است. الگوهای مربوط به همگرایی یا تمایل دنبالهها ممکن است به صورت زیر باشد.

- همگرایی دنباله (به مفهوم کلاسیک)، تمایل به رسیدن به یک نقطه ثابت است که آن نقطه؛ ممکن است حاصل از پیشامد تصادفی باشد.

- تمایل دنباله متغیرهای تصادفی به سمت یک تابع که به طور کامل قابل شناسایی است، همگرایی نامیده میشود.

- همگرایی به یک پیشامد تصادفی مشخص ممکن است در یک دنباله از متغیرهای تصادفی رخ دهد.

- دوری (Aversion) یا واگرایی از یک پیشامد مشخص نیز به عنوان یکی از مباحث مربوط به همگرایی تصادفی مطرح است.

- در همگرایی تصادفی، ممکن است توزیع احتمالی برای دنبالهای از پیشامدها به یک توزیع خاص تمایل داشته باشند که در ادامه در مورد آن صحبت خواهیم کرد.

همچنین میتوان الگوهای نظری زیر را هم در این زمینه در نظر گرفت که بخصوص بحث آمار ریاضی نیز مورد توجه هستند.

- ممکن است در بحث همگرایی، «مقدار مورد انتظار» (Expected Value) یا همان «امید ریاضی» (Mathematical Expectation) دنباله متغیرهای تصادفی به یک مقدار مشخص و ثابت، تمایل داشته باشد.

- در صورت وجود همگرایی در دنباله متغیرهای تصادفی ، واریانس یا پراکندگی دنباله متغیرهای تصادفی حول مرکزشان (امید ریاضی) با افزایش جملات دنباله، کمتر و کمتر شود.

برای مثال متغیرهای تصادفی را در نظر بگیرید (). اگر امید ریاضی () و واریانس () همه این متغیرهای تصادفی برابر و یکسان باشد، میتوان مجموع آنها را که به بستگی دارد، دنبالهای از متغیرهای تصادفی در نظر گرفت.

در رابطه بالا، اگر مقدار به سمت بینهایت میل کند، در احتمال به سمت میانگین ها یا همان میل خواهد کرد. معنی عبارت «در احتمال» در ادامه بیشتر روشن خواهد شد. این موضوع به «قانون ضعیف اعداد بزرگ» (Weak Law of Large Numbers) معروف است. البته همگرایی دنباله متغیرهای تصادفی موضوع قضیه یا قوانین دیگری مانند «قضیه حد مرکزی» (Central Limit Theorem) و «قانون قوی اعداد بزرگ» نیز هست.

در ادامه بحث دنباله متغیرهای تصادفی را با نماد و مقداری که به آن همگرا است را به صورت یک متغیر تصادفی در نظر میگیریم. فضای احتمال نیز برای پیشامدها به صورت خواهد بود.

نکته: همانطور که در قسمتهای بالایی خواندید، همگرایی دنباله متغیرهای تصادفی مورد بحث قرار گرفت. ولی این موضوع میتواند برای همگرایی دو دنباله نیز در نظر گرفته شود. ولی اغلب سادهتر است که به جای بررسی دو دنباله، دنبالهای از تفاضل یا نسبت آنها را مد نظر قرار داده و بررسی همگرایی و پیدا کردن نقطه همگرایی را برای آنها انجام داد.

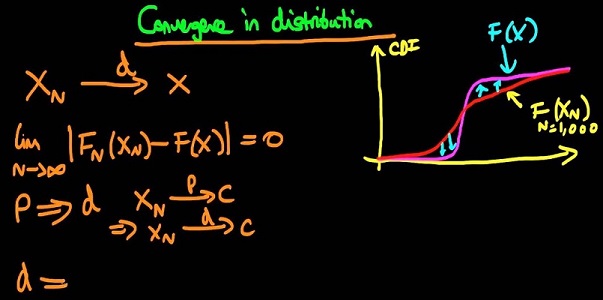

شیوه و نوع نزدیک شدن دنباله متغیرهای تصادفی به سه شکل یا صورت در تئوری احتمال در نظر گرفته میشود. «همگرایی در توزیع» (Convergence in Distribution)، «همگرایی در احتمال» (Convergence in Probability) و «همگرایی تقریبا مطمئن» (Convergence Almost Surely) که هر یک از آنها در این نوشتار مورد توجه و بحث قرار میگیرند.

همگرایی دنباله متغیرهای تصادفی در توزیع

یک دنباله از متغیرهای تصادفی، در توزیع، همگرا است اگر میزان انتظارمان برای مشاهده پیشامد بعدی از آن دنباله از نتایج آزمایش تصادفی، بر اساس «توزیع احتمالی» (Probability Distribution) مورد نظر، بیشتر و بیشتر شود.

این گزاره را به صورت رسمی به صورت زیر ارائه یا تعریف میکنیم.

همگرایی دنباله متغیرهای تصادفی در توزیع: دنباله متغیرهای تصادفی با مقادیر حقیقی را «همگرا در توزیع» (Convergence in Distribution) یا «همگرایی ضعیف» (Weak Convergence) یا «همگرایی در قانون» (Convergence in Law) به سمت متغیر تصادفی گوییم اگر رابطه زیر برقرار باشد.

$$ \large { \displaystyle \lim_{n \to \infty } F_{n}(x) = F(x),}\ $$

که در آن یک عدد حقیقی و نیز یک تابع پیوسته است. البته در نظر داشته باشید که هم و هم توابع توزیع تجمعی متغیرهای تصادفی به ترتیب و محسوب شدهاند.

در اصل تنها شرطی که باید در این نوع همگرایی لحاظ شود، پیوستگی تابع است. برای مثال اگر هر یک از ها دارای «توزیع یکنواخت» (Continuous Uniform Distribution) در بازه باشند، آنگاه همگرایی به نقطه یا متغیر تصادفی براساس همگرایی در توزیع حاصل میشود. در حقیقت f به ازای مشخص است که برای همه بوده و برای مقدار تابع توزیع احتمال برابر با ۱ است.

نکته: البته اگر آنگاه حتی زمانی که است. در نتیجه همگرایی تابع توزیع احتمال در نقطه در صورت پیوسته نبودن تابع ، نقض میشود.

همگرایی در توزیع برای یک دنباله متغیرهای تصادفی به شیوههای مختلفی نماش داده میشود. در ادامه به بعضی از نمادهای همگرایی در توزیع اشاره کردهایم.

برای مثال اگر بخواهیم نشان دهیم که دنباله به توزیع نرمال با میانگین صفر و واریانس ۱ همگرا در توزیع است، از نماد زیر استفاده خواهیم کرد.

نکته: برای بردارهای تصادفی با مقادیری که زیر مجموعهای از باشند نیز همگرایی در توزیع تعریف میشود. طبق تعریف بالا، دنبالهای از بردارهای تصادفی در توزیع به بردار همگرا است، اگر تساوی زیر برقرار باشد.

که زیر مجموعه از فضای بٰعدی است و مجموعهای از نقاط پیوستگی است.

تعمیم همگرایی دنباله متغیرهای تصادفی در توزیع

تعریف همگرایی در توزیع را میتوان از بردارهای تصادفی به «عناصر تصادفی» (Random Elements) در یک «فضای متریک» (Metric Space) دلخواه، گسترش داد و حتی یک گام جلوتر برداشته و برای متغیرهایی تصادفی که «اندازهپذیر» (Measurable) نبوده و فقط به صورت مجانبی (Asymptotically) اندازهپذیر هستند تعریف کرد. این موضوع برای مثال در زمینههایی که مربوط به «فرآیندهای تجربی» (Empirical Processes) است نیز به کار برد. معمولا در این حالت به جای همگرایی در توزیع از عبارت «قانون همگرایی ضعیف در توزیع - بدون آگاهی از توزیع دقیق» (Weak Convergence of Laws without Laws being defines) استفاده میکنند.

در چنین مواردی به کارگیری واژه همگرایی ضعیف ترجیح دارد و میگوییم که دنباله «عناصر تصادفی» (Random Elements) مانند همگرای ضعیف به است اگر رابطه زیر برقرار باشد.

توجه داشته باشید که یک تابع پیوسته کراندار بوده و در اینجا همان امید ریاضی است و نیز امید «ریاضی خارجی» (Outer Expectation) است.

همانطور که میدانید، منظور از امید ریاضی خارجی کوچکترین تابع اندازهپذیر است که تابع را تحت پوشش (Dominate) قرار میدهد.

خصوصیات همگرایی دنباله متغیرهای تصادفی در توزیع

از آنجایی که برای نقطه تابع توزیع تجمعی (CDF) به صورت تعریف میشود، همگرایی در توزیع به معنی آن است که برای به اندازه کافی بزرگ، احتمال اینکه که در یک بازه کراندار به قرار گیرد، تقریباٰ برابر با احتمال آن است که متغیر تصادفی در همان بازه قرار گرفته باشد.

اگر یک دنباله از متغیرهای تصادفی در توزیع همگرا به متغیر تصادفی باشند، دلیلی ندارد که تابع چگالی (PDF) آنها هم به تابع چگالی احتمال متغیر تصادفی همگرا باشد. برای مثال متغیر تصادفی با تابع چگالی زیر را در نظر بگیرید.

این دنباله از متغیرهای تصادفی همگرا به توزیع یکنواخت در بازه است در حالیکه تابع چگالی آنها اصلا همگرا نیست.

نکته: بنا بر قضیه شفه (Scheffe Theorem)، همگرایی در چگالی، همگرایی در توزیع را نتیجه میدهد ولی عکس آن صحیح نیست.

اگر دنباله متغیرهای تصادفی به همگرا باشند آنگاه گزارههای زیر معادل هستند.

- برای هر یک از عناصر دنباله یعنی مثلا در هر نقطه از پیوستگی تابع احتمال مثل ، داریم:

- امید ریاضی هر تابع کراندار و پیوسته مثل از دنباله متغیرهای تصادفی نیز به امید ریاضی تابع در نقطه همگرا است. به بیان ریاضی میتوان نوشت:

- حد بزرگترین کران پایین (Infimum) امید ریاضی تابعی از دنباله تصادفی برای هر تابع نامنفی و پیوسته در رابطه زیر صدق میکند.

- برای هر مجموعه باز (Open Set) مثل رابطه زیر برقرار است. به این معنی که حد کران پایین مقدار احتمال تعلق هر عضو دنباله مثلا به یک مجموعه باز، بزرگتر از مقدار احتمال تعلق به این مجموعه است.

- برای هر مجموعه بسته (Closed Set) مثل رابطه زیر برقرار است. به این معنی که حد کران بالای مقدار احتمال تعلق هر عضو دنباله مثلا به یک مجموعه باز، بزرگتر از مقدار احتمال تعلق به این مجموعه است.

- «قضیه نگاشت پیوسته» (Continuous Mapping Theorem) بیان میدارد که برای هر تابع پیوسته مثل ، اگر دنباله همگرا به در توزیع باشد، آنگاه دنباله نیز به در توزیع همگرا است.

نکته: با توجه به موضوع بالا نمیتوان نتیجه گرفت که برای دو دنباله همگرای و که به ترتیب به و در توزیع همگرا هستند، آنگاه نیز به همگرا است. این موضوع برای تفاضل و ضرب دنبالهها نیز نتیجه نمیشود.

«قضیه پیوستگی لوی» (Levy's Continuity Theorem) بیان میکند که در صورت همگرا بودن «تابع مشخصه» (Characteristic Function) هر یک از متغیر تصادفی به تابع مشخصه ، میتوان گفت که دنباله نیز به در توزیع همگرا است و برعکس. یعنی همگرایی در توزیع، همگرایی در تابع مشخصه را هم نتیجه میدهد. به این ترتیب اگر تابع مشخصه را با نشان دهیم، خواهیم داشت:

به یاد دارید که تابع مشخصه متغیر تصادفی میتواند به صورت منحصر به فردی، توزیع آن را مشخص کند.

مثال ۱. کارخانه تولید تاس

فرض کنید یک کارخانه جدید تولید تاس افتتاح شده است. اولین گروه محصول تولیدی این کارخانه، تاسهایی کاملا اریب (Biased) هستند زیرا هنوز دستگاهها و تجهیزات کالیبره و تنظیم نشدهاند. به همین دلیل هیچ یک از این تاسها دارای توزیع دلخواه یکنواخت گسسته (Discrete Uniform Distribution) نیستند.

تجهیزات و ماشینآلات کالیبره شده و تاسهای تولیدی نیز هر روز دارای اریبی کمتری میشوند، بطوری که تاسهای جدید تولیدی تقریبا نااریب (Unbiased) بوده و به توزیع یکنواخت نزدیک و نزدیکتر میشوند.

مثال ۲. پرتاب سکه

فرض کنید نسبت تعداد شیرها به خطها بعد از بار پرتاب یک سکه باشد. واضح است که دارای توزیع برنولی با پارامتر احتمال یا میانگین تعداد موفقیت و واریانس است. آنگاه زیردنباله (Sub sequence) متغیرهای تصادفی دارای توزیع دوجملهای (Binomial Distribution) خواهد بود.

هر چه تعداد پرتابها () بیشتر شود، توزیع جملات این دنباله به توزیع زنگی شکل نرمال (Bell Curve) نزدیک و نزدیکتر خواهد شد. اگر با تغییر مکان و مقیاس متغیر تصادفی را به تبدیل کنیم، توزیع دنباله حاصل به توزیع نرمال استاندارد همگرا میشود. البته این موضوع را نیز به وسیله «قضیه حد مرکزی» (Central Limit Theorem) میتوانستیم نتیجه بگیریم.

مثال ۳. همگرایی دنباله متغیرهای تصادفی با توزیع یکنواخت به متغیر تصادفی نرمال

دنباله از متغیرهای تصادفی مستقل و همتوزیع با «توزیع یکنواخت پیوسته» (Continuous Uniform Distribution) در بازه در نظر بگیرید.

طبق قضیه حد مرکزی، توزیع حدی ها که بوسیله نرمالسازی روی جمع ساخته میشود، با افزایش و میل کردن آن به سمت بینهایت، به توزیع نرمال با میانگین صفر و واریانس همگرا است.

نکته: به یاد دارید که میانگین و واریانس توزیع یکنواخت به صورت زیر محاسبه میشود.

و

در تصویر زیر این همگرایی را تا مشاهده میکنید. البته به نظر می رسد، زمانی که تعداد تکرارها تقریبا برابر با 5 است، همگرایی رخ داده است.

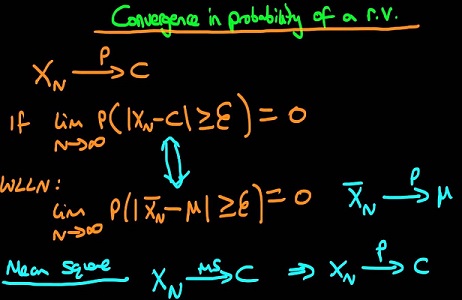

همگرایی دنباله متغیرهای تصادفی در احتمال

منظور از همگرایی در احتمال، کوچک بودن jاحتمال رخداد پیشامدهای نامعمول (Unusual) است. به این معنی که احتمال آنکه فاصله نقاط دنباله از مقدار مربوط به همگرایی آنها بزرگتر از هر مقدار مثبتی باشد، لحظه به لحظه با رشد مقدار ، کوچکتر و کوچکتر میشود به طوری که در نهایت میتوان آن را صفر در نظر گرفت. بنابراین تعریف رسمی برای همگرایی را به صورت زیر ارائه میکنیم.

نکته: در بحث مربوط به برآوردگرهای سازگار، همگرایی در احتمال مورد نظر است. برای آشنایی بیشتر با این نوع برآوردگرها بهتر است نوشتار برآوردگر سازگار در آمار — به زبان ساده را از مجله فرادرس مطالعه کنید.

همگرایی دنباله متغیرهای تصادفی در احتمال: برای دنباله متغیرهای تصادفی ، همگرایی در احتمال به متغیر تصادفی وجود دارد، اگر رابطه زیر برای هر مقدار مثبتی مثل برقرار باشد.

به تعبیر دیگر فرض کنید که احتمال آن باشد که متغیر تصادفی خارج کرهای با شعاع و مرکز قرار گیرد. در این صورت به ازاء هر و همگرا در احتمال به است، اگر مقداری مثل (که شاید به یا بستگی داشته باشد) موجود باشد که در رابطه زیر صدق کند.

چنین رابطهای درست به مانند تعریفی است که از حد (Limit) در نهایت برای یک تابع در نظر میگیریم.

از طرفی همانطور که در این تعریف مشخص است، برای دنباله ، یک دنباله از احتمالات نیز معرفی میشود که حد آن برابر با صفر است. پس در همگرایی در احتمال با یک دنباله از احتمالات هم مواجه هستیم که برای همگرایی باید نشان دهیم که این دنباله، همگرا است.

نکته: توجه داشته باشید که با توجه به شرایط، برای هر ، متغیرهای تصادفی و ممکن است مستقل از یکدیگر نباشند. در نتیجه همگرایی در احتمال، به معنی همگرایی در تابع توزیع توام (Joint CDF) نیز خواهد بود که در مقابل همگرایی در توزیع است که به توزیع توام توجهی ندارد.

همگرایی در احتمال را به شیوهها و نمادهای مختلفی نشان میدهند که در ادامه به بعضی از آنها اشاره میکنیم.

تا به حال براساس فضای احتمال عمل کردیم ولی اگر فضای متریک جداپذیر (Separable Metric Space) مثل را در نظر بگیریم، دنباله عناصر تصادفی را هم به همگرا گوییم اگر رابطه زیر براساس تعریف حد، برقرار باشد.

مثال 4

یک آزمایش تصادفی را در نظر بگیرید که در گام اول آن یک نفر از بین جمعیتی به طور تصادفی انتخاب میشود. قد او را به عنوان یک متغیر تصادفی مثل اندازهگیری کرده و ثبت میکنیم. در گام دوم از افراد دیگر میخواهیم بدون ابزار اندازهگیری و فقط با چشم، قد او را حدس بزنند. به این ترتیب حدس نفر اول برای قد او به صورت و همینطور تا نفر ام به شکل ثبت میشود.

میانگین حدس نفر اول، یک متغیر تصادفی است که آن را به صورت نشان میدهیم.

با فرض اینکه چشم همه سالم بوده و «خطای سیستماتیک» (Systematic Error) در اندازهگیری چشمی حضور ندارد، طبق قانون اعداد بزرگ، و براساس همگرایی در احتمال، دنباله متغیرهای تصادفی به سمت در احتمال میل خواهد کرد.

خصوصیات همگرایی دنباله متغیرهای تصادفی در احتمال

در این قسمت با بعضی از خصوصیات همگرایی در احتمال و دنبالههایی که در احتمال همگرا هستند، خواهیم پرداخت.

- میتوان نشان داد که همگرایی در احتمال، همگرایی در توزیع را نتیجه خواهد داد.

- همگرایی در توزیع، فقط زمانی که متغیر تصادفی تباهیده (یا ثابت) باشد، همگرایی در احتمال را نتیجه میدهد. قبلا در مورد همگرایی احتمال و توزیع توام صحبت کردیم. با توجه به اینکه متغیر تصادفی ، مقداری ثابت است، توزیع توام و با توزیع حاشیهای یکسان است در نتیجه میتوان همگرایی در توزیع را با همگرایی در احتمال در اینجا یکسان دانست.

- همگرایی در احتمال نمیتواند همگرایی تقریبا مطمئن را نتیجه بدهد. در مورد این نوع همگرایی در ادامه متن بحث خواهیم کرد.

- به کمک «قضیه نگاشت پیوسته» (Continuous Mapping Theorem) میتوان همگرایی یک دنباله از متغیرهای تصادفی را به تابعی پیوسته از آنها نیز نسبت داد. در نتیجه رابطه زیر برای هر تابع پیوسته برقرار است.

- همگرایی در احتمال، یک توپولوژی (Topology) روی فضای متغیرهای تصادفی در یک فضای احتمال ثابت ایجاد میکند. فاصله در این فضای توپولوژی به صورت زیر تعریف میشود.

همگرایی دنباله متغیرهای تصادفی تقریبا مطمئن

این نوع همگرایی بسیار شبیه به «همگرایی نقطه به نقطه» (Point-wise Convergence) در آنالیز حقیقی (Real Analysis) است و به صورت زیر تعریف میشود.

همگرایی دنباله متغیرهای تصادفی تقریبا مطمئن: دنباله همگرای «تقریبا مطمئن» (Almost Surely) یا «تقریبا همه جا» (Almost Everywhere) یا «با احتمال یک» (With Probability One) یا «همگرایی قوی» (Strongly) به دارد، اگر رابطه زیر برقرار باشد.

رابطه بالا نشان میدهد که همه نقاطی که در حد به میل میکنند با احتمال یک رخ میدهند و نقاطی که این تساوی بینشان برقرار نیست، مجموعه نقاطی با احتمال رخداد صفر است.

این موضوع را به کمک تابع احتمال و فضای پیشامد به شکل زیر نشان میدهیم.

اگر بخواهیم با نماد حد و سوپریمیم دنباله مجموعهها، همگرایی تقریبا مطمئن را نشان دهیم، از رابطه زیر استفاده خواهیم کرد.

مثال 5

یک جانور که دارای عمر کوتاهی است (مثلا یک پروانه) را در نظر بگیرید. میزان غذای مصرفی روزانه چنین جانوری را به صورت یک دنباله تصادفی به شکل n فرض میکنیم. با توجه به طول عمر کم این جانور مشخص است که به ازاء مقدار مشخصی، مقدار برابر با صفر خواهد بود. در نتیجه میتوانیم بگوییم که دنباله در احتمال به سمت میل میکند.

مثال ۶

فردی را در نظر بگیرید که هر روز صبح یک سکه را هفت بار پرتاب میکند. بعد از ظهر همان روز، به ازاء تعداد شیرهای مشاهده شده، به یک خیره ۱۰۰۰ تومان پرداخت میکند. در روز اول، تمامی پرتابها، خط بودهاند. میتوان نتیجه گرفت که او هرگز به خیره کمک نخواهد کرد.

فرض کنید میزان کمک او به خیریه باشد. ما تقریبا مطمئن هستیم که در یکی از روزها، میزان کمک او صفر تومان است. از این موضوع نتیجه میگیریم که او همیشه به مقدار صفر تومان به خیریه کمک خواهد کرد.

توجه داشته باشید که پیشامد آنکه در بعضی از روزها (تعداد روزهای متناهی) این قاعده بشکند و میزان پرداخت او به خیریه مثبت باشد، نیز وجود دارد ولی در مجموع و با افزایش تعداد روزها، عملا پرداختی صورت نخواهد گرفت.

معمولا همگرایی تقریبا مطمئن را به صورت نماد نشان میدهند.

خصوصیات همگرایی دنباله متغیرهای تصادفی تقریبا مطمئن

با توجه به خصوصیاتی که همگرایی دنباله متغیرهای تصادفی به صورت تقریبا مطمئن دارد، میتوان به موارد زیر اشاره کرد.

- اگر و میتوان نتیجه گرفت که رابطه به صورت تقریبا مطمئن، یا با احتمال یک، برقرار است.

- اگر و آنگاه رابطه به صورت تقریبا مطمئن، یا با احتمال یک، برقرار است.

- اگر و آنگاه نیز در احتمال به میل خواهد کرد.

- اگر و آنگاه نیز همگرای تقریبا مطمئن به دارد.

- اگر و آنگاه نیز همگرای تقریبا مطمئن به دارد.

- هیچکدام از رابطههای بالا براساس همگرایی در توزیع، نتیجه نخواهد شد.

همگرایی نقطه به نقطه یا مطمئن

برای آنکه نشان دهیم، همگرایی مطمئن (Sure Convergence) یک دنباله از متغیرهای تصادفی مثل به برقرار است از رابطه زیر استفاده میکنیم.

توجه دارید که در این حالت فضای احتمال به صورت در نظر گرفته شده است. به این ترتیب هر یک از پیشامدهای ساده درون فضای نمونه (Sample Space) هستند.

همگرایی دنباله متغیرهای تصادفی به صورت مطمئن را گاهی «همگرایی نقطه به نقطه» (Point-wise Convergence) نیز مینامند. بنابراین از نماد یا رابطه زیر نیز برای نشان دادن همگرایی نقطه به نقطه یا مطمئن استفاده میشود.

تفاوت اصلی بین همگرایی دنباله متغیرهای تصادفی با احتمال یک و با همگرایی نقطه به نقطه، در مجموعهای از پیشامدها است که احتمال رخداد آن صفر است. به همین علت کمتر از همگرایی مطمئن در احتمال صحبت شده و به کار گرفته میشود.

نکته: همگرایی مطمئن برای دنباله متغیرهای تصادفی، همه همگراییهای دیگر نظیر همگرایی در توزیع، همگرایی در احتمال و همگرایی تقریبا مطمئن را هم نتیجه میدهد.

خلاصه و جمعبندی

در این نوشتار با موضوع همگرایی دنباله متغیرهای تصادفی آشنا شدیم. همچنین مشخص شد که این همگرایی از جنبههای مختلفی مانند همگرایی در توزیع، همگرایی در احتمال و همگرایی تقریبا مطمئن دستهبندی میشود. همگرایی دنباله متغیرهای تصادفی بخصوص در نظریه احتمال و آمار ریاضی کاربرد دارد.

اگر این مطلب برای شما مفید بوده است، آموزشها و مطالبی که در ادامه آمدهاند نیز به شما پیشنهاد میشوند:

- مجموعه آموزشهای ریاضی

- آموزش آمار و احتمال مهندسی

- مجموعه آموزشهای آمار و احتمالات

- توزیعهای آماری — مجموعه مقالات جامع وبلاگ فرادرس

- متغیر تصادفی و توزیع برنولی — به زبان ساده

- توزیع نرمال یک و چند متغیره — مفاهیم و کاربردها

^^

سلام وقت بخیرببخشیدیک سوال داشتم راجع به توزیع مجانبی،میتونیدکمکم کنید؟