قضیه حد مرکزی و تعمیم آن – به زبان ساده

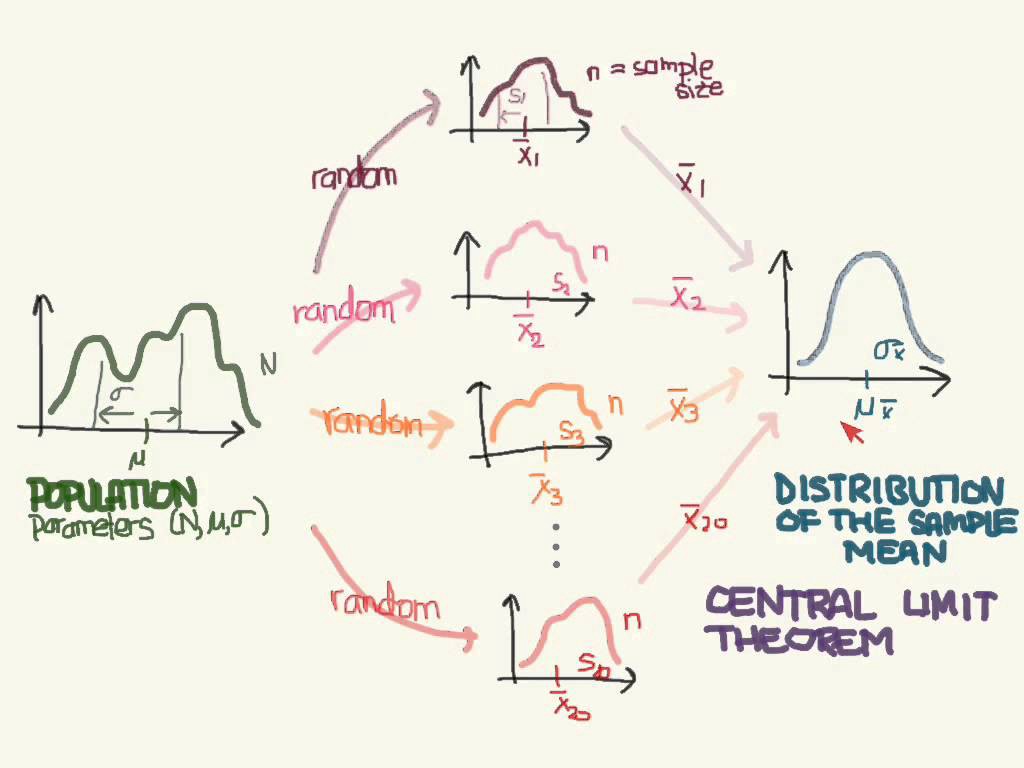

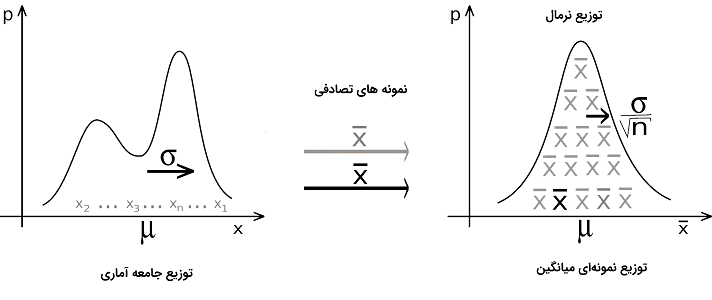

یکی از قضیههای مهم و البته کاربردی در نظریه آمار، «قضیه حد مرکزی» (Central Limit Theorem) است که گاهی آن را به صورت CLT نیز نشان میدهند. به کمک این قضیه ارتباط بین متغیرهای تصادفی با توزیعهای مختلف با «توزیع نرمال» (Normal Distribution) یا «توزیع گاوسی» (Gaussian Distribution) بیان میشود. در این نوشتار به بررسی قضیه حد مرکزی و تعمیم آن خواهیم پرداخت و شرایط استفاده از آن را مرور خواهیم کرد. همچنین نگاهی هم به «قضیه حد مرکزی تعمیم یافته» (Generalized Central Limit Theorem) خواهیم داشت که مرتبط با «توزیعهای پایدار» (Stable Distributions) است. علاوه بر این موارد این قضیه را در حالت چند متغیره نیز مورد کاوش قرار خواهیم داد.

برای آشنایی بیشتر با توزیع نرمال بهتر است مطلب توزیع نرمال یک و چند متغیره — مفاهیم و کاربردها را مطالعه کنید. گاهی در این متن به قانون اعداد بزرگ اشاره خواهیم کرد. بنابراین بهتر است مطلب امید ریاضی (Mathematical Expectation) — مفاهیم و کاربردها را نیز مطالعه کرده باشید. از طرفی آگاهی از خصوصیات توزیعهای پایدار که در نوشتار خانواده توزیع های پایدار — مفاهیم اولیه به آن پرداختهایم، خالی از لطف نیست.

قضیه حد مرکزی و تعمیم آن

قضیه حد مرکزی مرتبط با توزیع مجموع متغیرهای تصادفی مستقل و هم توزیع است. به این ترتیب اگر بدانیم که متغیرهای مستقلی هستند و البته توزیع یکسانی هم دارند (در این حالت به آنها iid میگوییم) میتوانیم توزیع احتمال مجموع آنها را، زمانی که به اندازه کافی بزرگ باشد، نرمال در نظر بگیریم. نکته جالب در این قضیه عدم اطلاع از توزیع متغیرهای تصادفی است.

شرط متناهی بودن واریانس، مستقل و هم توزیع بودن متغیرهای تصادفی از پیشنیازهای اصلی استفاده از این قضیه است. به این ترتیب شرایط استفاده از قضیه حد مرکزی را به صورت زیر معرفی میکنیم.

- متغیرهای تصادفی دارای توزیع یکسان باشند. به این معنی که علاوه بر هم خانواده بودن توزیع متغیرها باید پارامترهای یکسانی داشته باشند. البته ممکن است این پارامترها از قبل مشخص نباشند.

- متغیرهای تصادفی باید از یکدیگر مستقل باشند. از آنجایی که اثبات این قضیه بوسیله تابع مشخصه انجام میشود، باید بتوان توزیع توام متغیرها را به صورت حاصلضرب توزیعها نوشت. از آنجایی که این کار در صورت استقلال متغیرها امکانپذیر است، یکی از شرایط مهم در قضیه حد مرکزی مستقل بودن متغیرهای تصادفی در نظر گرفته شده است.

- متناهی بودن واریانس نیز از شرایط دیگر و مهم برای قضیه حد مرکزی است. اگر واریانس متغیرهای تصادفی ثابت و متناهی نباشند، قضیه حد مرکزی اعتبار خود را از دست خواهد داد و ممکن است مجموع دنبالهای از متغیرهای تصادفی به یک توزیع پایدار دیگر میل کند.

برای محاسبه احتمال بسیاری از توزیعها، میتوان از تقریب نرمال استفاده کرد. برای مثال میتوان به پرتاب یک سکه اشاره کرد. اگر متغیر تصادفی را برابر با مقدار ۱ در صورت مشاهده شیر و مقدار صفر در صورت خط بودن سکه در نظر بگیریم، واضح است که با یک «توزیع برنولی» (Bernoulli Distribution) مواجه هستیم. به منظور برآورد احتمال موفقیت (احتمال مشاهده شیر) سکه را به تعداد زیاد پرتاب میکنیم.

از آنجایی که هر بار پرتاب سکه مستقل از دفعات دیگر است و پارامتر توزیع برنولی در هر بار تکرار تغییر نمیکند (توزیع برنولی با پارامتر ثابت)، مشخص است که مجموع این متغیرهای تصادفی برنولی، دارای «توزیع دوجملهای» (Binomial Distribution) است. با توجه به بزرگ بودن مقدار (تکرار آزمایشهای پرتاب سکه) محاسبه احتمال براساس توزیع دوجملهای سخت خواهد بود. قضیه حد مرکزی از آنجایی که واریانس توزیع برنولی متناهی است قابل استفاده بوده و میتوان توزیع احتمالی برای مجموع یا میانگین ها که به نوعی برآورد برای احتمال موفقیت در آزمایش برنولی است را توزیع نرمال در نظر گرفت. البته شرط مستقل و هم توزیع بودن به همراه ثابت بودن واریانس در این مثال مشخص است.

در قسمتهای بالایی مطلب، شناخت اولیه و به نسبت خوبی درباره قضیه حد مرکزی بدست آوردهاید. در ادامه انواع این قضیه را به کمک روشهای تعمیمی آن نیز بررسی خواهیم کرد. اما در صورت تمایل به استفاده از آموزشهای ویدئویی، پیشنهاد میکنیم که فیلم رایگان زیرا را در فرادرس مشاهده کنید. در فیلم زیر، این قضیه به زبان ساده و همراه با چند مثال توضیح داده شده است.

قضیه حد مرکزی کلاسیک

شکلها و شرایط مختلفی برای قضیه حد مرکزی وجود دارد. در این قسمت به بررسی قضیه حد مرکزی کلاسیک میپردازیم. صورت این قضیه به تفسیر زیر است.

قضیه حد مرکزی: فرض کنید، یک نمونه تصادفی تایی مستقل و همتوزیع (iid) به صورت در اختیار داریم. امید ریاضی توزیع ها برابر با و واریانس آنها نیز است. در این صورت میانگین نمونهای یا که به صورت زیر معرفی میشود به طور مجانبی (با افزایش ) دارای توزیع نرمال خواهد بود که گاهی آن را توزیع نمونهای میانگین میگویند.

البته طبق شرایط مطرح شده و «قانون اعداد بزرگ» (Law of Large Numbers) میدانیم که میانگین نمونهای به میانگین توزیع میل خواهد کرد. یعنی رابطه زیر برقرار است.

ولی قضیه حد مرکزی از این مرحله یک گام به جلو برداشته و در مورد توزیع نیز توضیح میدهد. در این صورت میتوان رابطه زیر را طبق قضیه حد مرکزی نوشت.

رابطه بالا میتواند به شکل تقریبی و مجانبی، تابع احتمال میانگین توزیع یعنی را مشخص کند. به این ترتیب رابطه زیر نیز برقرار خواهد بود.

قضیه حد مرکزی لیندبرگ-لوی

فرض کنید دنبالهای از متغیرهای تصادفی مستقل و همتوزیع (iid) به صورت موجود باشد که . اگر به اندازه کافی بزرگ باشد () آنگاه رابطه زیر برقرار است.

با توجه به اینکه همگرایی در توزیع موضوع مورد بحث در قضیه حد مرکزی است، میتوان همگرایی نقطه به نقطه (Pointwise) برای تابع توزیع را نیز در نظر گرفت. به این ترتیب برای پیدا کردن احتمال تقریبی تا نقطه برای مجموع یا میانگین متغیرهایی تصادفی با هر توزیعی، از قضیه حد مرکزی استفاده میشود. در این صورت رابطه زیر برقرار خواهد بود. واضح است که منظور از تابع توزیع متغیر تصادفی نرمال استاندارد است.

نکته: تفاوت این قضیه با حالت کلاسیک در دنباله نامتناهی از متغیرهای تصادفی است.

قضیه حد مرکزی در حالت چند بُعدی

اگر فرض کنیم که دنبالهای از متغیرهای تصادفی بُعدی داشته باشیم که دارای بردار میانگین و ماتریس کوواریانس باشند، بطوری که ها از یکدیگر مستقل و همتوزیع هستند، قضیه حد مرکزی را در حالت چند بُعدی نیز میتوان مطرح کرد. به این ترتیب میتوان گفت که مجموع بردارهای تصادفی با افزایش دارای توزیع نرمال چند متغیره خواهد بود. این موضوع به بیان ریاضی به صورت زیر نوشته میشود.

فرض کنید بردار تصادفی تایی به صورت زیر داشته باشیم. این متغیرها بُعدی در نظر گرفته شدهاند.

در این حالت مجموع این بردارهای تصادفی به شکل زیر در خواهد آمد.

به این ترتیب میانگین این بردارهای تصادفی براساس مجموعشان بدست خواهد آمد.

در نتیجه رابطه زیر برقرار است.

طبق قضیه حد مرکزی خواهیم داشت:

بطوری که ماتریس کوواریانس مطابق با رابطه زیر محاسبه میشود.

نکته: توجه داشته باشید که این ماتریس، ارتباط بین متغیرهای تصادفی نیست زیرا فرض بر این است که متغیرها از یکدیگر مستقل هستند. پس مشخص است که ماتریس کوواریانس مربوط به میزان ارتباط بین ابعاد متغیرها است نه خود متغیرها.

شبیه ساز توزیع نمونه گیری و قضیه حد مرکزی

برای درک بهتر مفهوم توزیع نمونهگیری و تغییرپذیری دادهها، میتوانید از شبیهساز تعاملی دانشگاه کلرادو استفاده کنید. در این شبیهساز با جمعآوری نمونههای متعدد از یک مجموعه داده، نحوه شکلگیری توزیع نمونهگیری را بهصورت لحظهای مشاهده میکنید. همچنین، میتوان تأثیر حجم نمونه را بر دقت برآوردها بررسی کرد و درک شهودی بهتری از قضیه حد مرکزی به دست آورد.

تعمیم قضیه حد مرکزی

«توزیعهای پایدار» (Stable Distributions) در تعمیم قضیه حد مرکزی کاربرد دارند. تعمیم قضیه حد مرکزی توسط «بوریس گندنکو» (Boris Gnedenko) و «آندری کولموگروف» (Andry Kolmogrov) در سال 1954 مطرح و اثبات شد.

این قضیه نشان میدهد که مجموع متغیرهای تصادفی با توزیع متقارن و با واریانس نامتناهی که دارای «توزیع دم سنگین» (Heavy Tailed Distribution) هستند (تغییرات در دمهای توزیع برای و نامنفی به صورت باشد) با افزایش به سمت توزیع پایدار میل خواهد کرد. اگر باشد، واریانس متناهی بوده و میتوان مطابق با قضیه حد مرکزی، توزیع حدی میانگین یا مجموع متغیرهای تصادفی iid را نرمال فرض کرد.

نکته: را پارامتر پایداری، را هم پارامتر مقیاس مینامند. توضیحات بیشتر در مورد پارامترهای توزیع پایدار را در نوشتار توزیع های پایدار — مفاهیم اولیه مطالعه کنید.

اگر به فراگیری مباحث مشابه مطلب بالا علاقهمند هستید، آموزشهایی که در ادامه آمدهاند نیز به شما پیشنهاد میشوند:

- مجموعه آموزشهای آمار، احتمالات و دادهکاوی

- آموزش آمار و احتمال مهندسی

- توزیع نرمال یک و چند متغیره — مفاهیم و کاربردها

- متغیر تصادفی و توزیع کوشی (Cauchy Distribution) — به زبان ساده

- توزیع های آماری F و T — مفاهیم و کاربردها

^^

قلم جذاب و توضیحات عالی دکتر ریبد عزیز، کم کم داره ما ریاضیمحضیها رو به آمار علاقمند میکنه ها!